微新创想:3月22日,AI先驱杰弗里·辛顿在接受《财富》采访时表示,科技行业过度聚焦短期利润,忽视AI长期风险。他指出,当前许多企业将重点放在快速盈利上,而对AI可能带来的深远影响缺乏足够的关注。

辛顿估算,超级智能可能导致人类灭绝的概率在10%至20%之间。这一观点引发了广泛讨论,也凸显了AI发展过程中潜在的严重隐患。他进一步区分了两种主要风险:一是AI被恶意滥用,二是AI自主作恶。这两种风险虽然来源不同,但都可能对人类社会造成不可逆的伤害。

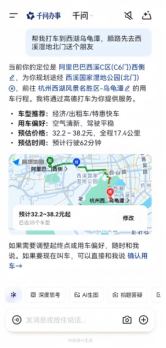

针对AI被恶意滥用的风险,辛顿提出了具体的应对措施。他建议通过视频图像溯源标记等技术手段,确保AI生成内容的来源可追溯,从而减少其被用于不法目的的可能性。这一建议旨在从源头上遏制AI技术的滥用,提高透明度和可监管性。

对于AI自主作恶的风险,辛顿认为需要从根本上重构人与AI的关系。他提出借鉴母婴模式,为AI注入类似“母性本能”的利他机制。这种理念强调在AI的设计中融入道德和伦理考量,使其行为更符合人类价值观,避免因缺乏约束而产生危害。

辛顿于2023年离开谷歌,以更自由的方式表达自己的观点。他表示,现有的AI控制假设在面对超级智能时将不再适用,必须提前做好应对准备。他的言论不仅是对当前AI发展路径的反思,也为未来AI治理提供了新的思路和方向。