微新创想:近日,开发者社区发现 MiniMax M2系列模型在输出特定人名“马嘉祺”时出现异常。这一现象引发了广泛关注,MiniMax 官方随即进行了全链路排查,并发布技术报告,揭示了这一问题背后的深层机制。报告指出,问题源于后训练阶段(Post-training)导致的低频 Token 退化。

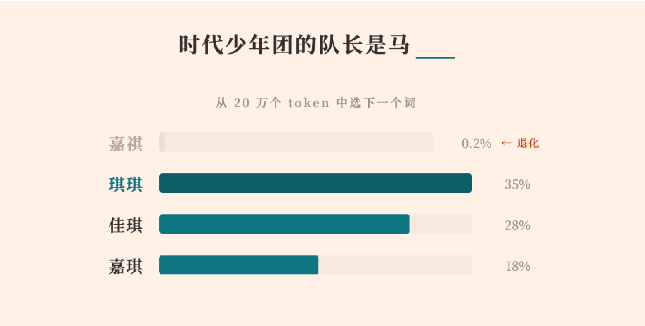

微新创想:根因定位显示,分词器将“马嘉祺”切分为 [‘马’, ‘嘉祺’]。进一步分析发现,“嘉祺”在预训练阶段出现频次高,被合并为独立 Token(编号190467)。然而,在决定模型对话能力的“后训练”阶段,包含该 Token 的样本不足5条。这种极低的出现频次导致该 Token 在向量空间中长期未被优化,被频繁更新的高频 Token(如代码符号、工具调用标记)挤压偏移。最终,模型虽然保留了关于马嘉祺的知识,却失去了输出对应 Token 的能力,转而选择音近的“佳琪”或“琪琪”。

微新创想:这一问题还引发了连锁反应,影响了日语与垃圾词的表达。通过对20万词表的扫描,MiniMax 发现约 4.9% 的 Token 存在显著退化。退化最严重的是日语内容(退化率29.7%),这解释了为何模型在日语对话中偶尔会混入俄语或韩语字符——因为日语 Token 发生了参数漂移,与其他语言在空间中产生了混淆。此外,退化名单中还包括大量的互联网 SEO 垃圾词(如“传奇私服”、“无痛人流”等)。由于这些词汇在对话数据中几乎为零,模型在后训练中逐渐“遗忘”了它们。

微新创想:为了解决这一问题,MiniMax 提出了三项核心修复策略。首先,构建全词表合成数据,通过复读任务确保每个 Token 在后训练阶段都有最低限度的练习频率。其次,混入预训练语料,在 SFT 数据中按比例加入预训练语料,利用其广度缓解遗忘。最后,进行词表裁剪与监控,移除永远不会被使用的冗余 Token,并将 Token 覆盖度纳入后训练质量监控指标。

微新创想:总结来看,“马嘉祺”事件并非孤例,它折射出大模型分词器设计与实际使用场景之间的脱节。MiniMax 表示,未来的数据覆盖策略需兼顾语义层面与统计层面,确保模型在习得“聊天能力”的同时,不丢失底层的词汇表达力。这一改进不仅有助于提升模型的准确性,也为大模型的训练与优化提供了新的思路。