微新创想:DeepSeek 在多模态能力的探索上迈出了令人瞩目的一步。在终于开始灰度测试其视觉功能后,它发布了一篇关于视觉推理技术的论文,但这篇论文很快被撤下,引发了不少猜测和讨论。4月29日,DeepSeek 研究员陈小康在 X 上发布了一条推文,配图中,DeepSeek 标志性的鲸鱼 logo 摘下眼罩,露出眼睛。这一举动仿佛在向外界宣告,视觉能力的探索已经进入新的阶段。

过去,DeepSeek 被广泛认知的是其在文本、代码和推理任务上的卓越表现。然而,真实世界的问题往往不是以文字形式出现的。它们可能是一张照片、一页图表、一个网页截图,甚至是一个需要理解空间关系和视觉细节的现实场景。对于 DeepSeek 来说,视觉能力是将其推理能力从文本世界延伸到真实世界的关键一步。而这次灰测的视觉能力,让使用者们感到不同:它不像其他模型那样简单地在语言模型基础上增加多模态功能,而是以一种更原生的方式进行视觉推理。

随着用户的好奇心不断上升,DeepSeek 发布了一篇名为《Thinking with Visual Primitives》的论文。从标题可以看出,DeepSeek 对视觉能力的理解,依然聚焦于推理和思考。它试图让模型在视觉层面使用最基本的空间元素进行更准确的判断。这并不是所有主流模型厂商在多模态领域所追求的方向,但这个想法却非常独特,也带来了新的研究思路。

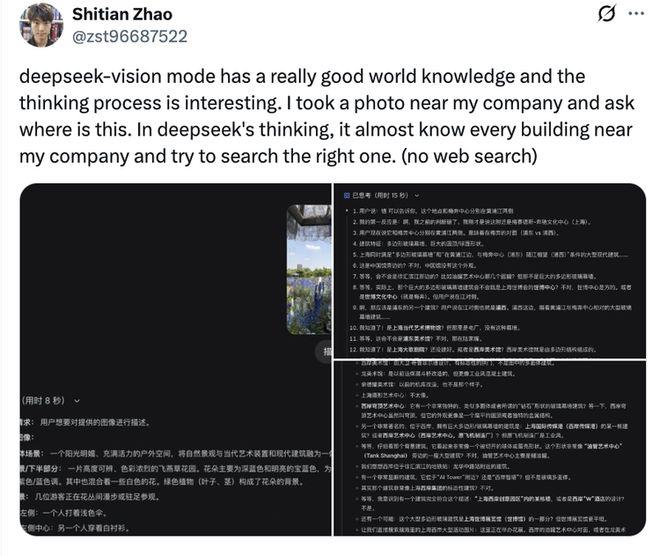

目前,DeepSeek 的视觉模式仍在灰度测试阶段,逐步向用户开放。从 X 上已经试用该功能的用户反馈来看,DeepSeek 的视觉能力不仅仅是识别图片内容,更在于将图像信息与已有的世界知识联系起来。一位用户在 X 上表示,DeepSeek 的视觉模式拥有非常丰富的世界知识,其思考过程也让人印象深刻。他上传了一张公司附近的照片,DeepSeek 在推理过程中几乎能识别出每一栋楼,并尝试找到正确的那栋。值得注意的是,这一过程并未依赖联网搜索。

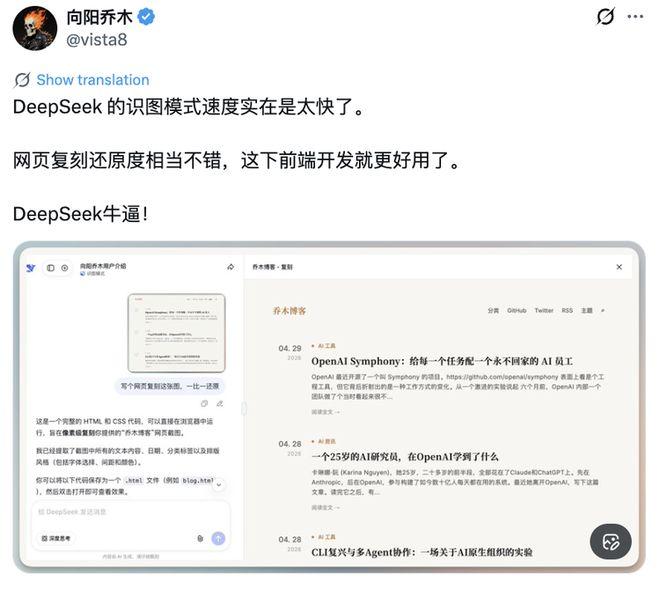

还有用户提到,DeepSeek 在网页复刻方面表现出色。这为设计师和产品经理提供了极大的便利,因为从 Figma、截图或参考网页到可点击的原型,以往需要设计师标注、开发切图、工程师实现的流程,现在可以被模型直接完成。这大大缩短了想法验证的时间,提高了效率。

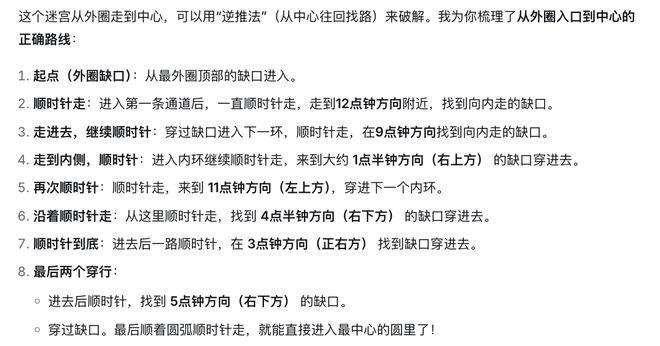

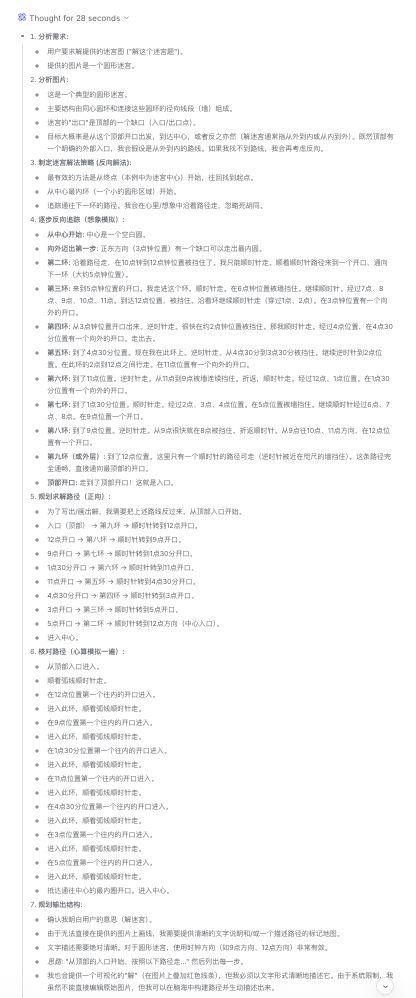

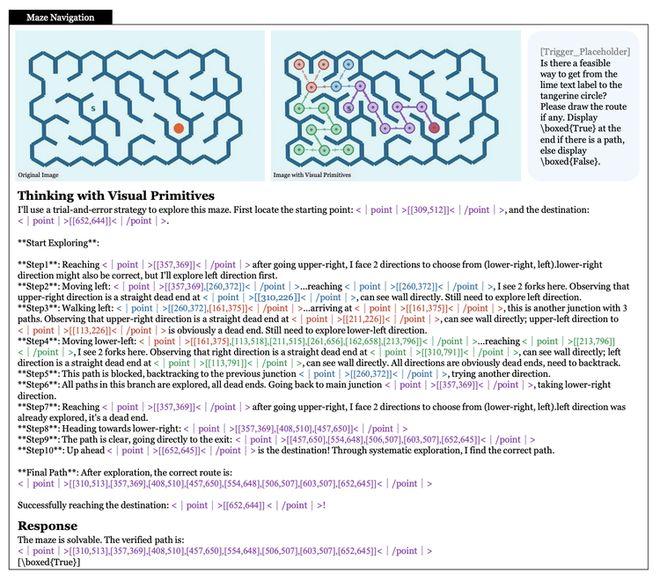

我亲自测试了 DeepSeek 的视觉理解能力。我上传了一张迷宫图,让它进行解答。DeepSeek 的思考过程非常严谨,它采用的是反向推理的方法,从终点出发,逐步反向追踪,直到找到起点。为了验证路径的可行性,它还用正向方式走了一遍,并再次核算,最终输出答案。整个过程中,DeepSeek 推理了四遍路径的可行性,显示出其在复杂任务上的稳定性。

陈小康在 30 号的推文中进一步解释了 DeepSeek 在视觉推理上的思路。他指出,传统的思维链(CoT)主要停留在语言空间,而视觉推理需要更多能力。通过将点和框作为认知锚点,DeepSeek 弥合了“指代鸿沟”,模拟了人类在视觉推理中常用的“指向—推理”协同机制。

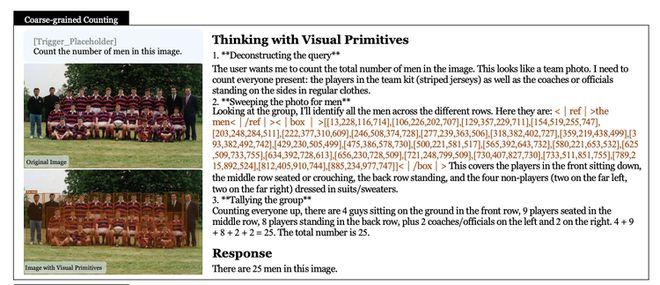

DeepSeek 提出了一种新的推理框架,即使用视觉基元进行思考。所谓视觉基元,可以理解为模型在图像中的“手指”。当模型需要判断一张合照中有多少人时,它会先用边界框将每个人标出,再进行统计。对于更复杂的细粒度计数任务,如“有几只熊在地面上”,模型会先找出所有熊,再逐一判断它们的位置和状态,最后得出答案。

视觉基元的引入,让模型的推理不再悬浮在语言描述中,而是被锚定在图像中的具体位置。这种方式不仅提高了推理的准确性,也让模型在处理空间关系和路径追踪时更加可靠。

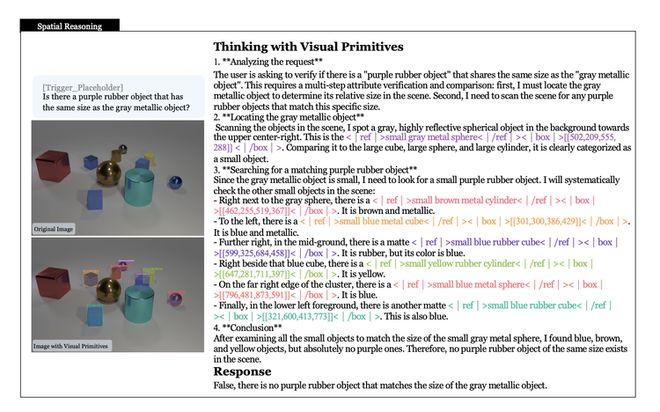

在空间推理任务中,DeepSeek 采用的是“定位—验证—统计”的流程。模型会先框出关键对象,再根据这些对象进行多步推理。例如,判断图中是否存在一个紫色橡胶物体,与灰色金属物体大小相同。模型会先定位灰色金属球,判断其大小;再逐一检查其他小物体,看它们的颜色、材质和大小是否匹配,最终得出结论。

在拓扑推理任务中,DeepSeek 主要使用点来表示路径。这类任务关注的是路径、连通性和结构关系,而不是物体本身。例如,判断迷宫中是否存在从起点到终点的路径,或者在交错线条中找到正确的延续路径。这类任务对多模态模型来说尤其困难,因为它们需要模型持续跟踪路径,而不是一瞥即答。

报告中提到,纯语言的思维链难以准确描述不规则形状的轨迹,因此使用点作为视觉基元,特别适合处理这类问题。在迷宫导航任务中,DeepSeek 会让模型先找到起点和终点,然后像做深度优先搜索一样探索路径。模型每走到一个关键位置,就用点坐标记录下来;如果遇到死路,就回退到前一个岔路口,再尝试另一条路径。

在线条追踪任务中,模型同样会用一串点来表示其沿着哪条线走。这类任务的核心挑战是交叉点消歧:当两条线交叉时,模型必须根据局部几何连续性判断哪一条才是目标线的延续,而不是被另一条线误导。为了防止模型仅凭颜色猜测,DeepSeek 还设计了所有线条颜色和粗细都相同的样本,迫使模型真正根据曲线连续性进行追踪。

尽管视觉基元带来了诸多优势,但它并不是视觉推理的终点。它的最大价值在于让模型的视觉推理变得更稳定,也更容易被验证。这会带来两个直接的好处:一是减少幻觉,模型在判断“这里有没有紫色橡胶物体”时,不再只是凭语义猜测,而是先在图中找到候选物体,再逐一排除;二是提高可解释性,例如当模型说一张图里有 25 个人时,如果它同时框出了这 25 个人,用户就能判断其是否准确。

这也是为什么 DeepSeek 的视觉模式在网页复刻、迷宫求解、复杂图像问答等场景中显得更有用。这些任务都需要模型理解页面结构、追踪路径或在多个视觉线索之间进行比对,而不仅仅是提供一句笼统的图片描述。视觉基元让模型能够稳定地“看图说话”,从而更好地应对这些挑战。

另一个优势是效率。DeepSeek 并不是简单依赖大量视觉 token 来弥补视觉能力,而是通过更高效的视觉 token 压缩架构,让模型在较低的图像 token 消耗下依然保持较强的推理能力。报告中提到,对于 800×800 的输入图像,其模型在 KV cache 中只保留大约 90 个条目,却能在计数和空间推理等基准测试中取得有竞争力的表现。

DeepSeek 的目标并不是无限提高分辨率或堆叠更多图像 token,而是让模型更有效地使用视觉信息。然而,这种思路也存在一定的局限。首先,输入分辨率的限制会影响模型在细粒度场景下的表现,有时会输出不够精确的视觉基元。这意味着,如果图像中的目标非常小、细节非常密集,或者区域边界模糊,点和框的标注可能会出现偏差。

其次,这种能力目前还依赖显式触发。报告中提到,当前使用视觉基元进行思考的功能需要通过明确的触发词来激活,未来希望模型能够根据具体上下文自主判断是否调用这一机制。这意味着,目前模型未必会在每个需要视觉定位的场景中自动使用这项能力。用户如果只是简单地问“这张图里有多少人”或“这条路能不能走通”,模型可能仍然使用普通语言推理,而不是主动输出点、框或路径。

最后,拓扑推理仍然是一项挑战。使用点作为视觉基元来解决复杂拓扑问题,目前还存在一定的困难。模型的跨场景泛化能力也有限,这意味着它在面对不同类型的视觉任务时,可能需要不同的处理方式。

视觉基元让模型开始能够在图像中定位、比较和追踪,但要真正处理开放世界中的复杂视觉问题,还需要更强的感知能力、更稳定的自主调用机制,以及更好的跨场景泛化能力。在视觉理解层面,DeepSeek 给出的答案是:让图像不再只是输入材料,而是成为模型推理过程的一部分。模型不只是看见世界,而是开始学会在世界中找到锚点。

这种做法不像是一次附带的研究,更像是 DeepSeek 对视觉能力的一种全新理解。因此,这次罕见的删除论文行为也引发了诸多猜测。有人认为,这种技术对于开源模型来说“太强大”,以至于不适合公开。真相如何,或许还要等 DeepSeek 自己给出解释。