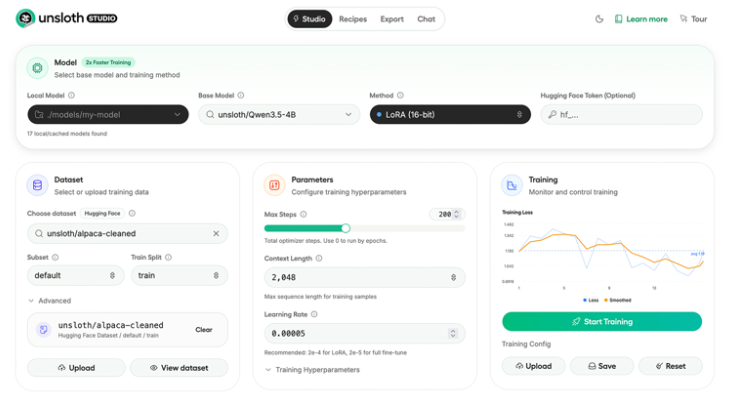

微新创想:Unsloth AI 正式推出了 Unsloth Studio 这款全新的开源工具。Unsloth Studio 作为一款无代码的本地可视化界面,为软件工程师提供了更简便的方式来微调大语言模型。它消除了传统微调过程中对复杂 CUDA 环境配置的依赖,同时大幅降低了硬件成本,使更多开发者能够轻松参与大模型的训练与优化。

微新创想:Unsloth Studio 的核心技术基于 Triton 语言编写的定制化反向传播内核,这一创新带来了显著的性能提升。相比标准微调框架,Unsloth Studio 的训练速度提升了两倍,同时显存占用减少了70%。这意味着在不牺牲模型精度的情况下,开发者可以更高效地进行训练,而且无需昂贵的 GPU 集群。

微新创想:更重要的是,Unsloth Studio 支持消费级显卡,如 RTX4090 或 5090。这些单块显卡现在可以用于微调原本需要多卡运行的大型模型,例如参数量达到8B 或70B 的 Llama3.3 和 DeepSeek-R1。这一突破让企业与个人开发者都能在本地环境中进行高性能的模型训练。

微新创想:Unsloth Studio 提供了从数据准备到模型部署的完整生命周期管理。用户可以通过直观的 Web UI 进行操作,平台支持多种数据格式的自动摄取,包括 PDF 和 JSONL。此外,它还集成了 NVIDIA DataDesigner,能够将杂乱无章的文档转化为结构化的指令数据集,从而提高训练数据的质量与可用性。

微新创想:在训练方法上,Unsloth Studio 内置了对 GRPO(群组相对策略优化)的支持。这项技术源自 DeepSeek-R1,能够在不依赖额外“批判模型”的情况下,帮助本地硬件训练出具备多步逻辑推理能力的 AI 模型。这使得模型在复杂任务上的表现更加出色。

微新创想:Unsloth Studio 还支持一键导出和部署功能,用户可以轻松将训练好的模型导出为 GGUF、vLLM 或 Ollama 等格式,从而实现从训练检查点到生产环境推理的无缝衔接。这种便捷的操作方式大大缩短了模型部署的时间,提高了整体开发效率。

微新创想:随着 Unsloth Studio 的推出,大语言模型的微调正逐步从云端 SaaS 模式转向本地开发。这种转变不仅降低了成本,还增强了数据隐私和模型的可控性。Unsloth Studio 为 Llama4 和 Qwen 系列提供了即时兼容,同时也为企业打造专属的定制化模型提供了强大的支持。

微新创想:对于希望在本地环境中进行模型训练与优化的开发者来说,Unsloth Studio 是一个极具价值的工具。它不仅简化了流程,还提升了训练效率和资源利用率,让高性能的大模型微调变得更加普及和可行。