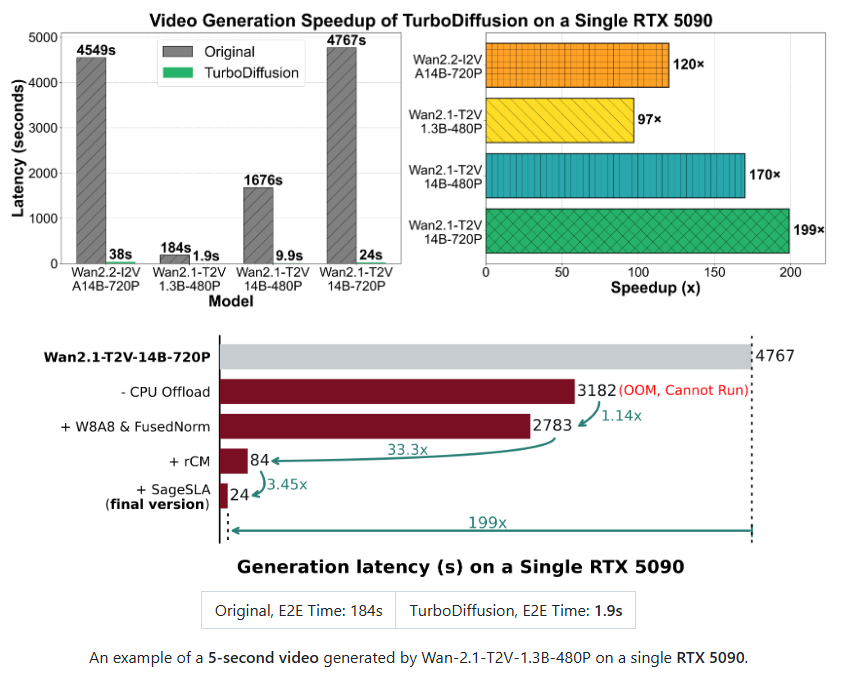

近日,清华大学TSAIL实验室携手生数科技正式发布了革命性的开源视频生成加速框架——TurboDiffusion。这一突破性技术框架在完美保留视频生成质量的前提下,实现了端到端扩散生成推理速度的惊人飞跃,最高提升达100至200倍。据AIbase独家获悉,该框架通过集成SageAttention与SLA(稀疏线性注意力机制),显著降低了模型处理高分辨率视频内容时的计算负担。同时,开发团队创新性地引入了rCM(时间步蒸馏)技术,大幅减少扩散过程中的采样步数,使视频生成在保持视觉一致性的基础上,实现了极低的计算延迟。

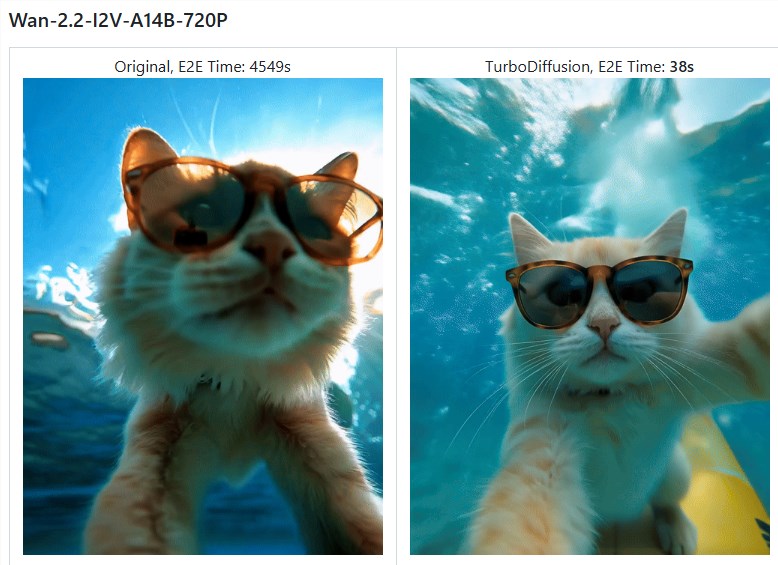

GitHub公布的实测数据显示,TurboDiffusion的加速效果堪称惊艳。在单张RTX5090显卡的测试中,原本需要184秒才能生成的5秒视频,使用该框架后仅需1.9秒即可完成。对于参数量更大的模型,性能提升更为显著:原本耗时约1.2小时的720P视频生成任务,现在被压缩至短短38秒,性能表现远超目前市面上的同类加速方案。

目前,TurboDiffusion已全面开源,并提供了多种规格的模型权重供用户下载。针对消费级显卡(如RTX4090/5090)和工业级显卡(如H100),团队分别开发了量化版与非量化版的优化方案。这一举措意味着无论是个人创作者还是企业级用户,都能通过这一强大工具显著提升AI视频的生产效率。

划重点:

⚡ 效能飞跃:清华开源框架将AI视频生成提速最高200倍,RTX5090显卡可实现1.9秒产出5秒视频。

🛠️ 技术核心:通过SageAttention、稀疏线性注意力机制以及时间步蒸馏技术,在不损耗画质的情况下大幅削减算力需求。

🌐 全面适配:框架已开放模型权重,并针对不同显存容量的显卡提供了量化优化方案,极大降低了高性能AI视频生成的门槛。