近日,AMD 与高通携手宣布一项重大合作成果——旗下硬件正式获得 OpenAI 推出的 gpt-oss 系列开放推理模型的全面支持,这一突破性进展为边缘计算与人工智能的深度融合奠定了坚实基础。OpenAI 最新发布的 gpt-oss 系列包含两款核心模型:参数量更小的 gpt-oss-20b 和架构更为复杂的 gpt-oss-120b。其中,gpt-oss-20b 模型对计算资源要求较低,仅需配备 16GB 内存即可实现流畅运行;而 gpt-oss-120b 模型则展现出更强的处理能力,能够在单块 80GB 显卡上高效执行任务。

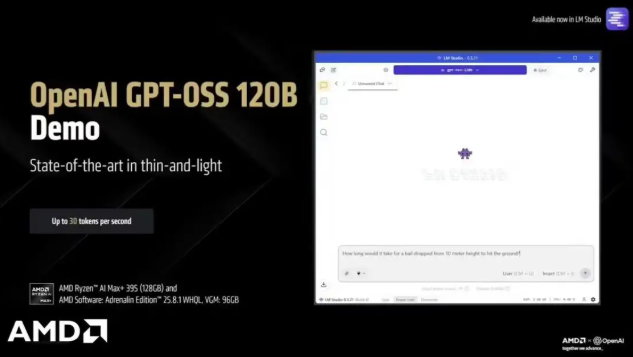

AMD 隆重宣布,其锐龙 AI Max+395 处理器作为全球首款消费级 AI PC 处理器,成功实现了 gpt-oss-120b 模型的运行。为了充分适配这一高性能模型,AMD 创新性地采用了 GGML 框架和 MXFP4 格式技术,使得 gpt-oss-120b 模型在约 61GB 显存的配置下依然能够保持卓越性能。值得一提的是,搭载 “Strix Halo” 平台的设备通过其 128GB 的统一内存系统,能够将高达 96GB 的内存资源分配给 GPU,从而完全满足 gpt-oss-120b 的运行需求。

在性能表现方面,锐龙 AI Max+395 处理器在运行 gpt-oss-120b 模型时,可实现每秒 30 个 Token 的输出速度,同时支持先进的 MCP 模型上下文协议。这一技术突破意味着用户在处理复杂 AI 任务时,将获得更快的响应速度和更高的工作效率。高通方面也分享了积极成果,经过早期测试发现,gpt-oss-20b 模型在其骁龙平台上展现出令人瞩目的思维链推理能力,为移动端 AI 应用开辟了新可能。

开发者现在可以通过 Hugging Face 和 Ollama 等主流技术平台,在搭载骁龙芯片的设备上便捷访问 gpt-oss 系列模型,充分释放其强大功能。这一跨界合作不仅彰显了 AMD 与高通在人工智能领域的战略远见,更为边缘计算和人工智能技术的未来演进指明了方向。随着 gpt-oss 模型的持续普及,我们有理由相信,未来将涌现出更多智能化设备和创新 AI 应用场景,推动整个行业迈向新高度。