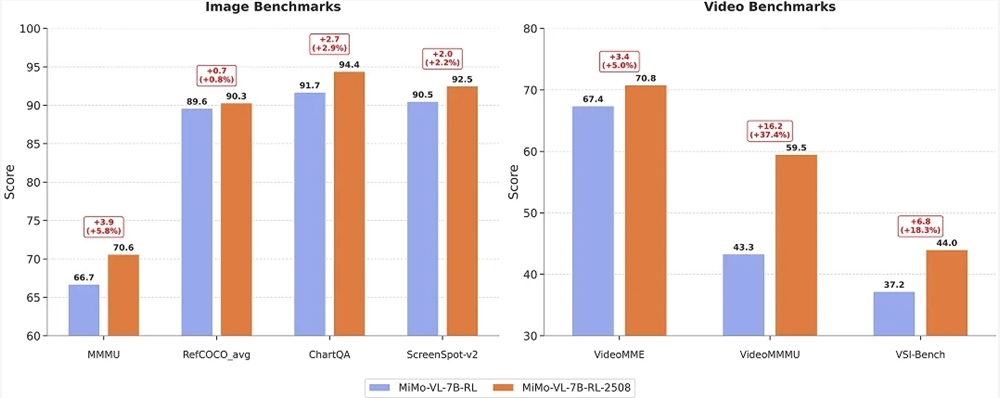

小米大模型团队正式发布开源最新一代多模态大模型——Xiaomi MiMo-VL-7B-2508,该模型提供强化学习(RL)与监督微调(SFT)两种版本,为开发者与研究人员带来更强大的多模态交互体验。官方权威数据显示,新版模型在学科推理、文档理解、图形界面定位及视频理解四项核心能力上实现了全面突破,各项指标均创下历史新高。其中,MMMU基准测试首次突破70分大关,ChartQA表现优异升至94.4分,ScreenSpot-v2达到92.5分,VideoMME也显著提升至70.8分,充分展现了模型在多模态任务处理上的卓越能力。

此次模型迭代通过深度优化强化学习稳定性与监督微调流程,使模型在内部VLM Arena评分中实现从1093.9到1131.2的显著跃升,性能提升幅度超过3%。尤为值得关注的是,该模型创新性地支持用户通过“/no_think”指令自由切换“思考”与“非思考”模式。在“思考”模式下,模型会全程展示推理链条,确保控制成功率100%,适合需要透明化推理过程的场景;而在“非思考”模式下,模型将直接生成答案,响应速度更快,成功率高达99.84%,满足用户对高效交互的需求。官方推荐用户在大多数情况下优先体验RL版本,以获得更全面的性能表现。

对于开发者而言,Xiaomi MiMo-VL-7B-2508提供了丰富的开源资源,用户可以根据实际需求灵活进行SFT或RL的定制开发。相较于上一版SFT模型,新版本在强化学习稳定性方面实现了显著提升,为模型在实际应用中的可靠性和一致性提供了有力保障。模型的开源地址已公布,RL版本用户可通过https://huggingface.co/XiaomiMiMo/MiMo-VL-7B-RL-2508获取,SFT版本用户则可访问https://huggingface.co/XiaomiMiMo/MiMo-VL-7B-SFT-2508下载,开发者可基于此模型构建个性化的多模态应用解决方案。