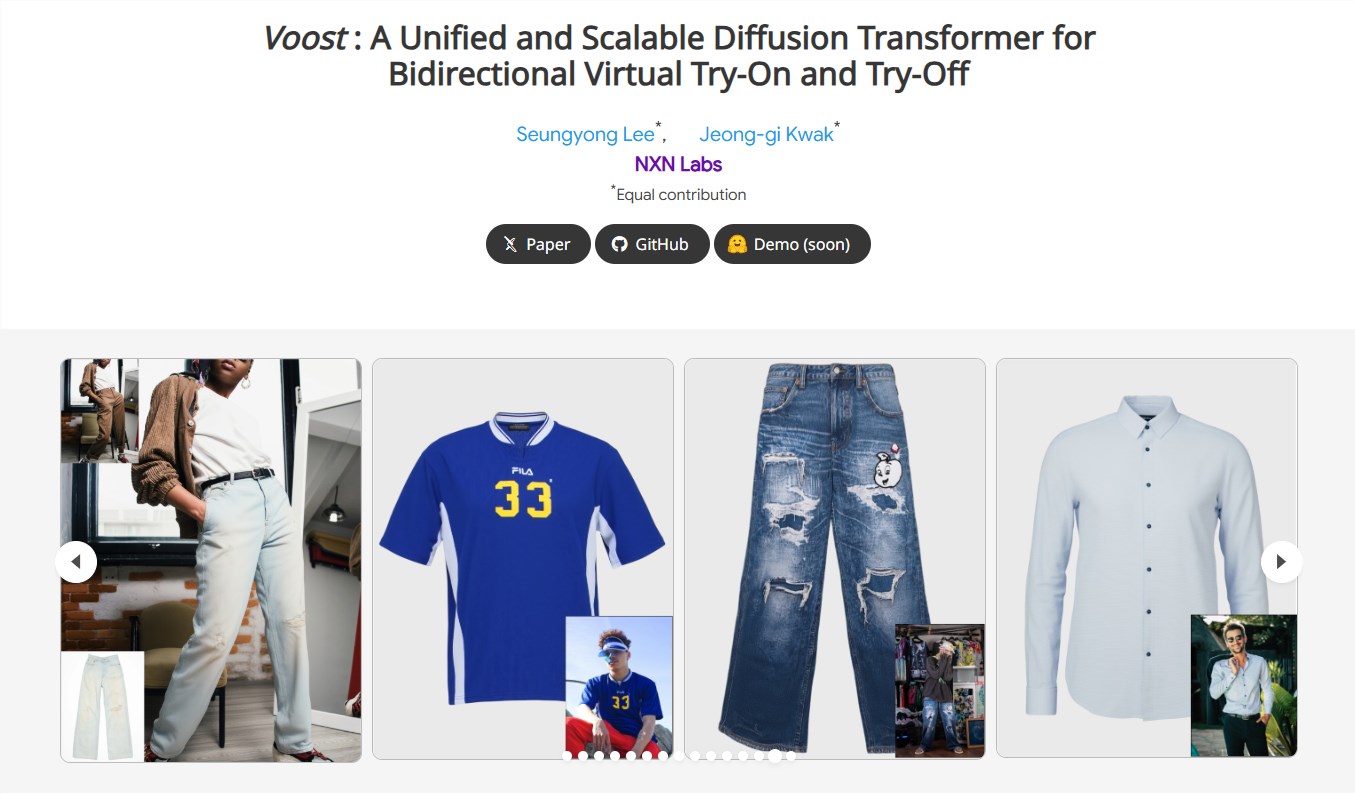

近日,研究人员推出了一项名为 Voost 的创新框架,旨在显著提升虚拟试衣和试脱技术的表现水平。虚拟试衣技术通过合成人体穿着目标服装的真实图像,为用户提供沉浸式试穿体验,然而由于人体姿态和外观的复杂变化,准确建模服装与身体的对应关系始终是一大技术瓶颈。Voost 框架的问世为这一难题提供了全新的解决方案。

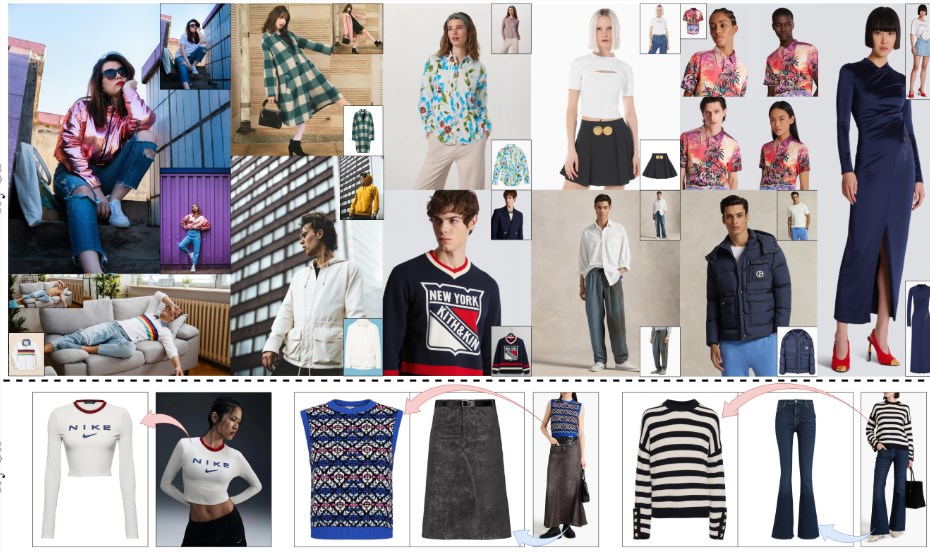

Voost 是一个高度统一且可扩展的模型体系,通过单一扩散变换器(DiT)同时处理虚拟试衣和试脱任务。与传统方法不同,Voost 采用双向监督机制,能够对每对服装和人体进行双向关联学习,从而显著增强服装与身体的语义关系推理能力。这一创新设计使得 Voost 在任务灵活性和生成多样性上具有突出优势,无需依赖特定任务的网络架构、辅助损失函数或额外的标签数据即可实现高效运行。

研究团队还引入两项关键技术以提升模型的鲁棒性。首先是注意力温度缩放技术,该技术能够在分辨率变化或局部遮挡等复杂情况下保持模型的稳定性;其次是自我校正采样机制,通过利用任务之间的双向一致性约束,进一步优化生成结果的质量。这些创新技术使 Voost 能够灵活适应各种输入场景,在复杂应用环境中依然保持出色的表现。

在大量实验验证中,Voost 表现出卓越的性能水平,达到了当前虚拟试衣和试脱技术的最新基准。研究数据显示,Voost 在对齐准确性、视觉逼真度以及泛化能力等多个关键指标上,均显著超越了包括扩散模型、生成对抗网络在内的多种强基线模型。这一突破性成果不仅为虚拟试衣和试脱技术发展开辟了新方向,也为未来相关领域的研究奠定了坚实基础。

Voost 的成功充分展示了深度学习技术在优化服装试穿体验方面的巨大潜力,预示着数字时尚和在线购物领域即将迎来革命性变革。该项目已开放访问,详情请参阅:https://nxnai.github.io/Voost/

划重点:

? Voost 是一种创新框架,通过单一扩散变换器实现虚拟试衣和试脱任务的高效协同学习

? Voost 在任务灵活性和生成多样性方面表现突出,无需特定网络架构和额外标签即可实现高性能

? 实验结果表明,Voost 在对齐准确性和视觉质量上全面超越多种强基线模型