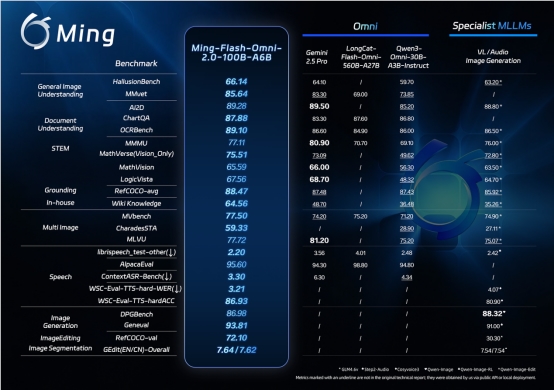

微新创想:2月11日,蚂蚁集团正式开源发布全模态大模型 Ming-Flash-Omni2.0。该模型在多个公开基准测试中展现出卓越的性能,尤其在视觉语言理解、语音可控生成、图像生成与编辑等关键领域表现尤为突出。部分核心指标甚至超越了 Gemini2.5Pro,成为当前开源全模态大模型中的性能新标杆。

Ming-Flash-Omni2.0是业界首个实现全场景音频统一生成的模型。它能够在同一条音轨中同时生成语音、环境音效与背景音乐,极大提升了音频内容的创作效率与表现力。用户只需通过自然语言下达指令,即可对音色、语速、语调、音量、情绪以及方言等参数进行精细控制,实现高度个性化的音频生成需求。

在推理性能方面,Ming-Flash-Omni2.0实现了3.1Hz的极低推理帧率,这意味着模型能够在分钟级的长音频生成中保持实时高保真输出。这一突破不仅提升了用户体验,也在推理效率与成本控制上保持了业界领先水平,为大规模应用提供了坚实的技术基础。

业内普遍认为,多模态大模型的发展趋势是走向更加统一的架构,从而实现不同模态与任务之间的深度融合与协同。然而,现实中“全模态”模型往往面临通用性与专精性的矛盾。在特定单项能力上,开源模型通常难以达到专用模型的水平。蚂蚁集团在全模态方向已深耕多年,Ming-Omni系列正是这一长期投入的成果体现。

从早期版本构建统一多模态能力底座,到中期版本验证规模增长对性能的提升,再到最新2.0版本通过更大规模的数据与系统性训练优化,Ming-Flash-Omni2.0将全模态理解与生成能力推向了新的高度。其性能不仅达到开源领先水准,还在某些领域超越了顶级专用模型。

此次开源发布,标志着Ming-Flash-Omni2.0的核心能力以“可复用底座”的形式对外开放。开发者可以基于同一套框架,便捷地调用视觉、语音与生成等多模态能力,从而显著降低多模型串联的复杂度与开发成本。这种统一的架构设计,为端到端多模态应用的开发提供了更高效的解决方案。

Ming-Flash-Omni2.0基于Ling-2.0架构(MoE,100B-A6B)进行训练,围绕“看得更准、听得更细、生成更稳”三大目标进行了全面优化。在视觉处理方面,模型融合了亿级细粒度数据与难例训练策略,显著提升了对近缘动植物、工艺细节和稀有文物等复杂对象的识别能力,为视觉理解任务提供了更精准的支持。

在音频生成方面,模型实现了语音、音效与音乐的同轨生成,支持用户通过自然语言对音色、语速、情绪等参数进行精细控制。此外,它还具备零样本音色克隆与定制能力,能够快速适应不同语音风格与需求,极大拓展了音频生成的边界。

图像生成与编辑能力也得到了显著增强。Ming-Flash-Omni2.0在复杂编辑任务中表现出更高的稳定性,支持光影调整、场景替换、人物姿态优化以及一键修图等功能。即使在动态场景中,模型也能保持画面的连贯性与细节的真实性,为图像创作提供了更强大的工具支持。

百灵模型负责人周俊指出,全模态技术的核心在于通过统一架构实现多模态能力的深度融合与高效调用。开源后,开发者可以更方便地利用这一框架,快速构建跨模态的应用场景。这不仅降低了技术门槛,也加速了全模态技术的普及与落地。

未来,蚂蚁团队将持续优化视频时序理解、复杂图像编辑以及长音频生成的实时性,进一步完善工具链与评测体系,推动全模态技术在实际业务中的规模化应用。目前,Ming-Flash-Omni2.0的模型权重与推理代码已在多个开源社区发布,用户也可通过蚂蚁百灵官方平台 Ling Studio 在线体验与调用该模型,开启多模态技术的新篇章。