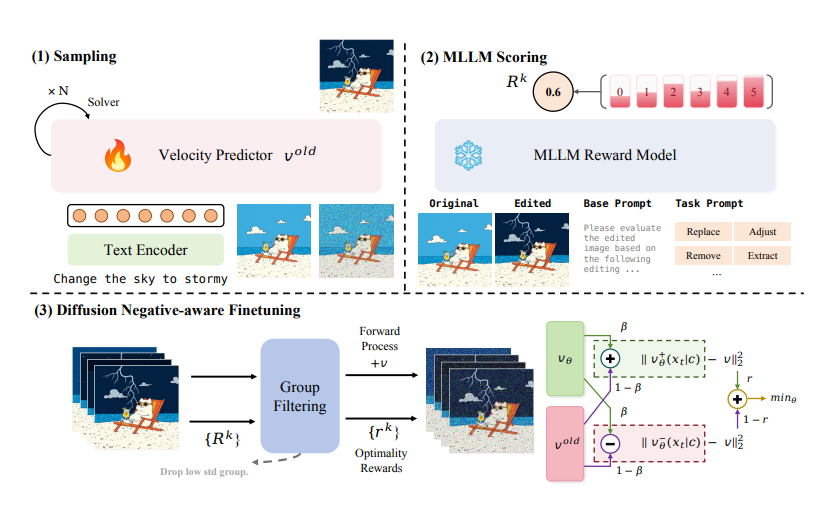

在图像编辑领域,一项革命性的技术正彻底颠覆传统认知!兔展智能携手北京大学 UniWorld 团队联合发布了新一代图像编辑模型——UniWorld-V2,这一突破性成果不仅在细节处理上超越了Nano Banana,更在中文指令理解上实现了质的飞跃。UniWorld-V2的核心驱动力是创新的视觉强化学习框架UniWorld-R1,该框架首次将强化学习策略优化技术引入图像编辑领域,通过智能算法显著提升了编辑的精准度和灵活性。与传统的监督微调方法相比,UniWorld-R1巧妙地解决了数据过拟合和泛化能力不足的难题,使模型能够从容应对各种复杂编辑指令。

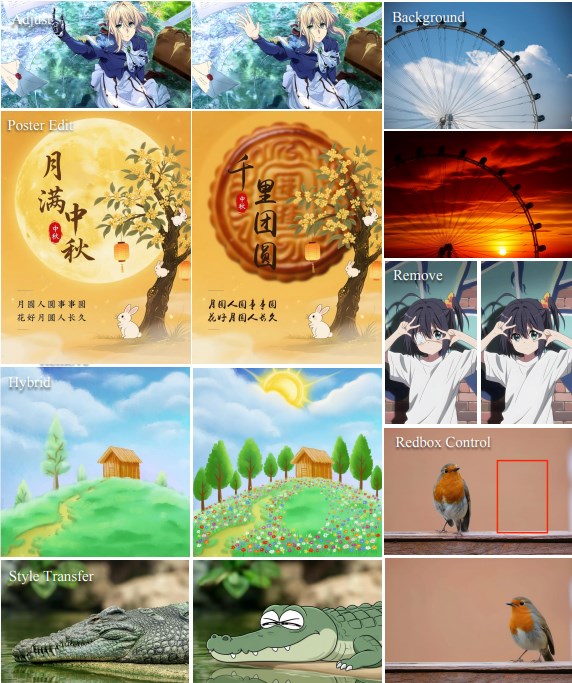

以手势修改为例,当用户要求AI将一位女生的手势调整为”OK”姿势时,UniWorld-V2能够精准捕捉用户意图并完成完美转换,而Nano Banana则明显缺乏这种理解能力。在海报编辑测试中,该模型更是展现出惊人的艺术表现力,能够精准渲染”月满中秋”等复杂中文艺术字体,确保文字效果既美观又符合语义要求。UniWorld-V2的精细化控制能力同样令人赞叹,用户只需简单框选目标区域,即可实现高难度的局部调整,比如将特定物体从画面中移除。此外,其在光影处理方面的卓越表现,能够自然地将编辑对象融入场景,大幅提升整体视觉效果。

在权威测试基准GEdit-Bench和ImgEdit的评测中,UniWorld-V2分别以7.83和4.49的优异成绩遥遥领先OpenAI的GPT-Image-1和Gemini2.0等知名模型。这些亮眼成绩的背后,是UniWorld-R1框架强大的通用性支撑,该框架不仅显著提升了UniWorld-V2的性能表现,也为其他图像编辑模型带来了革命性改进。令人欣喜的是,UniWorld-R1的论文、代码和模型已在GitHub和Hugging Face平台公开,为学术界和工业界的研究者提供了宝贵的资源,为未来图像编辑技术的发展奠定了坚实基础。

这一技术的问世,不仅推动了多模态领域的技术进步,更为图像编辑技术开辟了全新的可能性。通过将强化学习与视觉处理深度融合,UniWorld-V2展现了人工智能在创意领域的无限潜力,预示着未来图像编辑将更加智能、高效和人性化。论文地址:https://arxiv.org/abs/2510.16888GitHub链接:https://github.com/PKU-YuanGroup/UniWorld