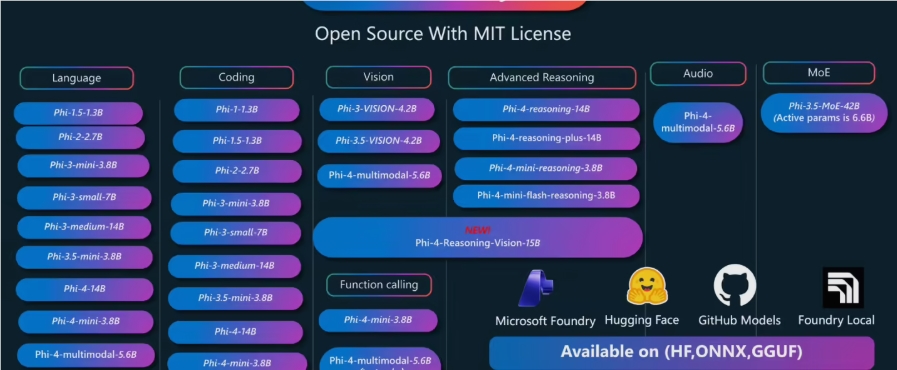

微新创想:微软近日在其开发者社区发布了一款名为 Phi-4-Reasoning-Vision-15B 的新型开源 AI 模型。这款模型不仅具备高分辨率的视觉感知能力,还能够进行深度推理,标志着 Phi-4 系列的一个重要突破。

作为首个同时具备 “看得清楚” 和 “想得深入” 特性的 “小语言模型”(SLM),Phi-4 的问世将为开发者开辟新的智能应用场景。与传统的视觉模型不同,Phi-4 不仅仅是被动地识别图像中的内容,而是能进行结构化和多步骤的推理。它能够理解图像中的视觉结构,并将其与文本上下文相结合,从而得出可操作的结论。

这种能力使得开发者能够创建从数据图表分析到用户界面自动化等多种智能应用。Phi-4 的设计特色在于其灵活的推理模式。当面对需要深入分析的任务时,比如数学问题或逻辑推理时,模型会切换到 “推理模式”,启用多步骤推理链。

而在需要快速反应的场景中,比如 OCR(光学字符识别)或元素定位时,它则能快速输出结果,以降低延迟。这种灵活性大大提升了模型的实用性和效率。

此外,Phi-4 的应用潜力巨大,尤其是在计算机智能体的使用场景中。用户只需提供一个屏幕截图和自然语言指令,模型便能输出所需 UI 元素的标准化边界框坐标,其他智能体模型则可以在此基础上执行点击、滚动等交互操作。

这样,Phi-4 将为用户带来更便捷的操作体验。总体来看,Phi-4-Reasoning-Vision-15B 不仅在技术上有所突破,也为智能应用的开发提供了强大的支持。随着这一模型的开源,期待更多开发者能够利用其先进功能,创造出更多令人惊叹的应用场景。