微软近期低调发布了一款名为VibeVoice-Realtime-0.5B的”黑马级”实时语音模型,这款开源文本转语音(TTS)技术或将成为全球延迟最低、最接近真人发音的解决方案之一。其核心优势在于极致的实时性,从文本输入到语音输出仅需300毫秒,远超传统TTS模型的1-3秒起音时间,带来堪比真人对话的流畅体验。

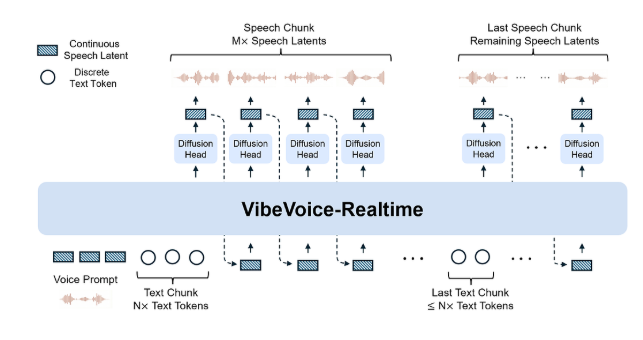

VibeVoice-Realtime-0.5B在长文本处理方面同样表现出色,单次可生成长达90分钟的高质量音频,全程保持语速稳定、发音准确、情绪自然,犹如专业播音员朗读。HuggingFace平台上的实测结果显示,即使处理整本《三体》第一章,模型也能完整流畅地完成朗读,毫无破音现象。

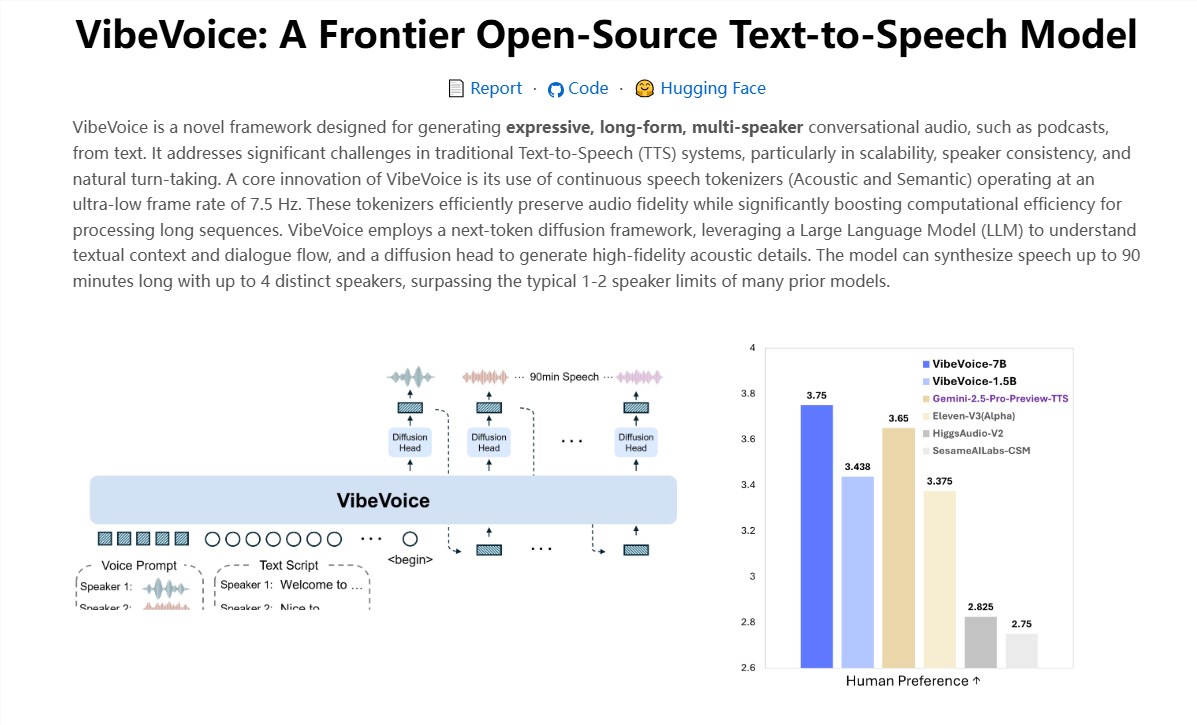

该模型特别适合多角色对话场景,原生支持最多4个角色同时发声,每个角色都能保持独立的声线、语速和语气特征。以播客访谈为例,主持人可以保持沉稳,嘉宾A可以表现得激动,嘉宾B可以展现幽默感,嘉宾C可以流露出歉意,四人轮流发言时互不串音,情绪切换自然流畅,堪称AI配音团队的天花板级表现。

VibeVoice-Realtime-0.5B内置情感感知模块,能够根据文本语义自动识别并添加对应情绪。例如在阅读”对不起”时会自然流露出歉意语气,遇到”太棒了!”时会立刻上扬表现出兴奋情绪,甚至对于”我很生气”这样的表达也会通过压低声线和加快语速来传递愤怒情绪,无需任何手动情绪标注即可开箱即用。

在语言支持方面,该模型同时支持中英文混读,英文发音已接近商用级别,中文发音准确自然度极高。虽然部分多音字和轻声词的处理仍有优化空间,但官方已承诺将推出专门的中文精调版本。

VibeVoice-Realtime-0.5B采用轻量级设计,仅0.5B参数量,推理时显存占用不到2GB,在普通笔记本电脑上即可实现实时运行。开发者已将其快速集成到本地AI助手、阅读应用和实时同传工具中,未来有望成为AI本地语音交互的标准配置。

目前VibeVoice-Realtime-0.5B已在HuggingFace和GitHub上完全开源(MIT协议),并支持商用。社区中已涌现出大量创新应用:有人将其用于实现”边打字边读”的微信语音输入功能,有人将其接续在大模型后,成功构建了全链路实时语音对话系统。

AIbase评论指出,当开源圈还在追逐10B+参数的巨型TTS模型时,微软凭借0.5B的小模型就实现了”实时、自然、长文本、多角色”的全面突破,堪称降维打击。接下来,国内科技企业将如何应对这一挑战,值得持续关注。

项目地址:https://microsoft.github.io/VibeVoice/