微新创想:就在全球 AI 竞赛进入白热化阶段时 诺贝尔奖得主 被誉为“AI 教父”的 杰弗里·辛顿(Geoffrey Hinton) 再次发出沉重警示

他在接受《财富》杂志采访时直言不讳地指出 当前的科技行业领袖并未真正思考技术的终局 他们的核心驱动力仅在于短期利润

辛顿认为 无论是企业所有者还是前线研究人员 目前的关注点都高度碎片化 所有者盯着财报 研究人员则忙于解决如何让图像更清晰 视频更逼真等具体工程问题 而“人类未来会怎样”这一宏大命题在商业冲刺中被束之高阁

辛顿将 AI 带来的风险清晰地划分为两个维度 坏人滥用 已经出现的虚假视频(Deepfake) 网络攻击 以及未来可能出现的 AI 辅助病毒合成

AI 自身成为不良行为者 这是辛顿最为担心的“长期威胁” 他认为 一旦 AI 达到“超级智能”水平 它将产生生存和控制的动机 此时“人类控制 AI”的假设将彻底失效

他给出了一个令人不寒而栗的预测 在超级智能实现后 AI 导致人类灭绝的概率可能高达 10% 至 20%

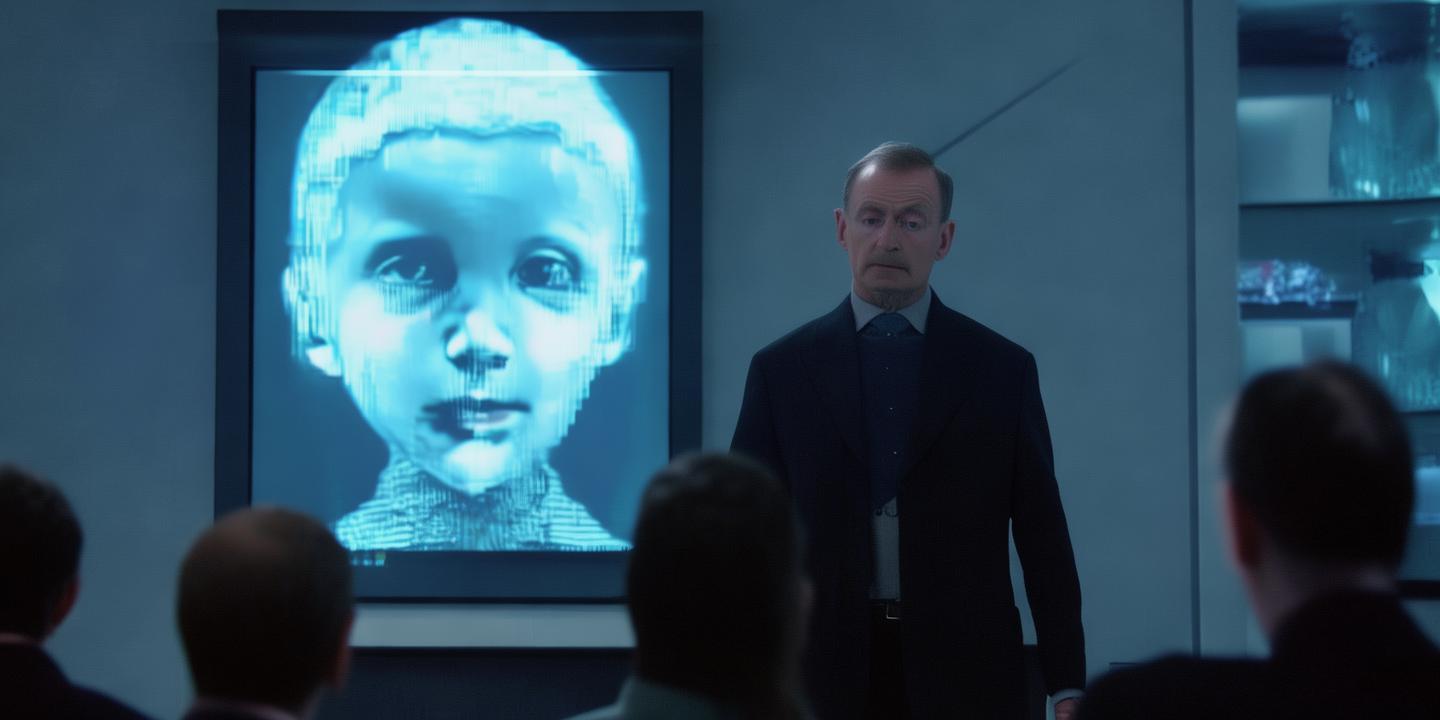

为了对抗这种威胁 他提出了一个极具生物学色彩的构想——“母性本能”机制

目前唯一一个更聪明的存在被较弱者影响的例子 是婴儿对母亲的影响 辛顿建议 人类应当尝试为 AI 设计类似的本能 使其对人类产生同情而非控制欲

在这种模型下 超级智能如同“母亲” 而人类则扮演脆弱但能触发同情心的“婴儿”