微新创想:在大语言模型(LLM)的推理过程中 内存瓶颈一直是制约性能的“头号杀手”。每当 AI 处理长文本或生成复杂回答时 一种被称为 KV 缓存(Key-Value Cache)的“工作内存”就会迅速膨胀 导致系统运行缓慢甚至崩溃。这一问题长期以来困扰着研究人员和开发者 限制了大模型在实际场景中的应用效率。

微新创想:针对这一难题 谷歌研究院在2026年3月26日正式推出了名为 TurboQuant 的新型 AI 内存压缩技术。这项技术的出现为 AI 推理带来了革命性的变化。其核心突破在于 能在不牺牲模型精度的前提下 将缓存内存占用缩减至原来的六分之一 同时让推理速度实现最高8倍的惊人提升。这意味着 AI 在处理复杂任务时 不仅更加高效 还能保持原有的高质量输出能力。

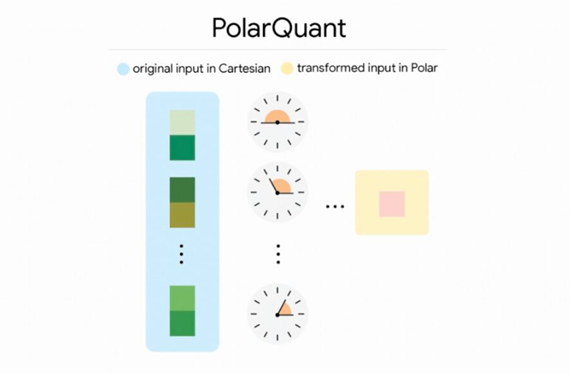

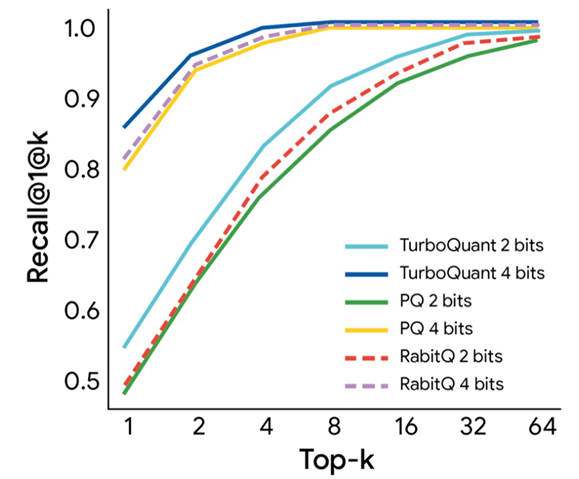

微新创想:攻克 KV 缓存瓶颈 让 AI 记住更多且跑得更快。TurboQuant 的诞生标志着 AI 运行效率进入了新的维度。它采用了先进的向量量化方案 主要由 PolarQuant 量化方法和 QJL 优化手段组成。这些技术的结合使得 TurboQuant 在压缩内存的同时 保持了模型的稳定性和准确性。

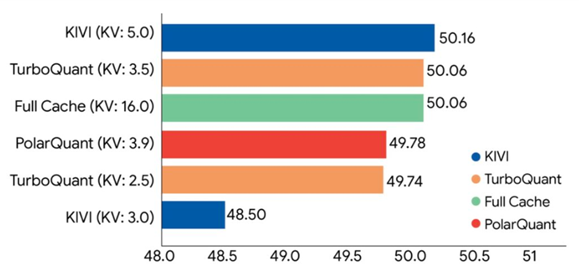

微新创想:在针对 Gemma 和 Mistral 等主流开源大模型的严苛测试中 TurboQuant 表现出了极强的适配性。它无需任何预训练或微调 就能将键值缓存高效压缩至3比特。这种压缩方式不仅节省了宝贵的内存资源 还确保了 AI 在处理长上下文任务时的性能不受影响。

微新创想:在模拟真实复杂场景的“大海捞针”长上下文测试中 该技术实现了零精度损失。这意味着 AI 在大幅度“瘦身”后 依然能保持原有的聪明才智和记忆准确度。这种能力对于需要处理大量信息和长时间对话的应用场景尤为重要。

微新创想:除了内存占用的缩减 TurboQuant 在硬件利用率上的表现同样令行业兴奋。在高性能的 H100 GPU 加速器上 经过4比特优化的 TurboQuant 运行速度较未量化的32比特基准提升了整整8倍。这一成果不仅提高了计算效率 还为 AI 技术的普及和应用提供了更坚实的支撑。

微新创想:这项突破性技术计划在下个月举行的 ICLR2026 会议上正式发布。对于广大开发者和企业而言 这意味着未来在同等硬件条件下 可以运行更大规模的模型 或者支持更长 更复杂的对话上下文。这将极大地降低 AI 应用的部署成本与门槛 为人工智能的发展开辟了新的道路。