英伟达研究团队近日重磅发布了全新一代全双工语音对语音对话模型——PersonaPlex-7B-v1,这款创新模型彻底颠覆了传统AI语音助手“听一句、回一句”的机械式交互模式,致力于打造高度接近人类的自然对话体验。与以往需要通过ASR(语音转文本)、LLM(大语言模型)、TTS(文本转语音)等多重环节串联的复杂架构不同,PersonaPlex-7B-v1采用革命性的单一Transformer架构,实现了语音理解与生成的端到端一体化处理。这种创新设计不仅大幅降低了系统响应延迟,更赋予了AI处理自然语言中断、语音重叠以及实时反馈的卓越能力。正如真人对话般流畅,AI能够在自我表达的同时持续倾听用户指令,即便遭遇突然打断也能迅速调整应对策略,展现出惊人的交互灵活性。

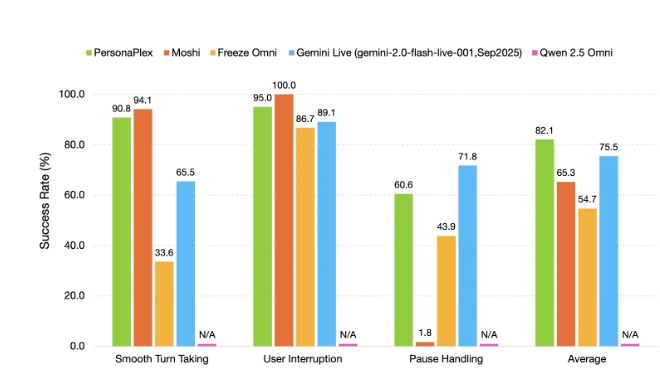

在个性化控制方面,该模型同样表现出色。通过“语音+文本”的双重引导机制,用户不仅可以自由定义AI的角色背景设定,还能精确调整其音色特质与语调风格。据AIbase独家获悉,英伟达在模型训练过程中巧妙融合了海量真实通话数据与精心设计的合成场景,使模型既具备地道的语言表达习惯,又能严格遵循特定行业的专业规范。权威评估数据显示,PersonaPlex-7B-v1在对话流畅度与任务完成效率两项关键指标上,均显著超越了市面上多数开源及闭源对话系统。更多技术细节请参考官方研究发布:https://research.nvidia.com/labs/adlr/personaplex/

划重点:🎙️ 全双工交互突破:PersonaPlex-7B-v1支持实时语音流动态处理,用户可在AI发言过程中随时插话或实现语音重叠,系统将做出即时响应,彻底打破传统对话的僵化限制。🧠 单一模型架构创新:摒弃传统插件式管道设计,采用高效Transformer结构同步预测文本与语音标记,从底层架构显著提升对话的自然性与连贯性。🎭 深度个性化定制:支持长达200token的系统提示词输入及专属语音嵌入技术,用户可灵活塑造AI的角色性格、专业领域知识储备以及情感化音色表达,实现高度个性化的交互体验。