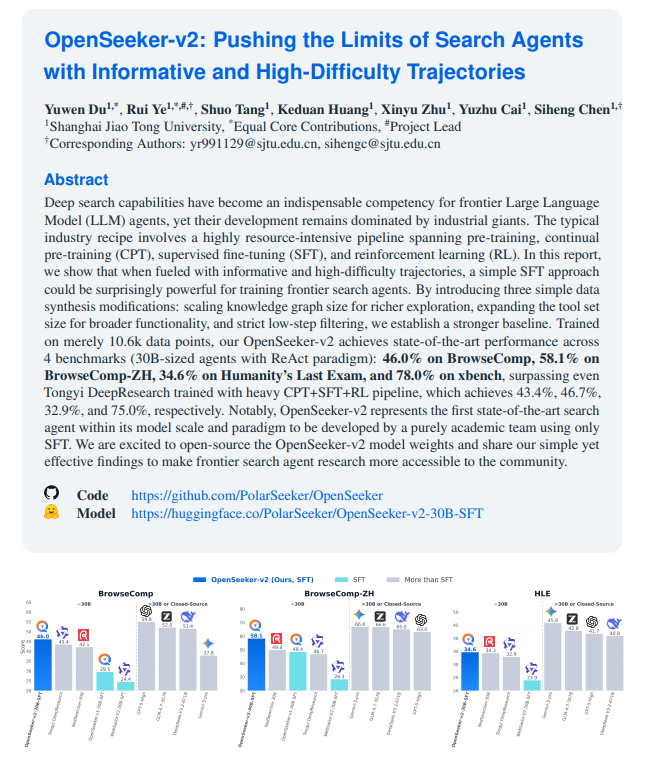

微新创想:在当前的大模型(LLM)领域 深度搜索能力已成为顶尖智能体的“必杀技” 然而 这一赛道的游戏规则长期以来被资源雄厚的工业巨头所主导 传统的开发模式通常依赖于极其消耗资源的流水线 包括预训练 持续预训练(CPT) 监督微调(SFT)以及强化学习(RL)

近日 来自学术界的研发团队发布了最新成果 OpenSeeker-v2 彻底打破了这一常规认知 研究报告指出 通过使用高质量 高难度的任务轨迹进行训练 即便仅采用简单的监督微调(SFT)方法 也能打造出性能顶尖的搜索智能体 该团队在数据合成方面提出了三项核心优化策略 首先是扩大知识图谱规模 以提供更丰富的探索空间 其次是显著增加工具集数量 扩展功能边界 最后是实施严格的低步数过滤 确保训练数据的精炼与高效

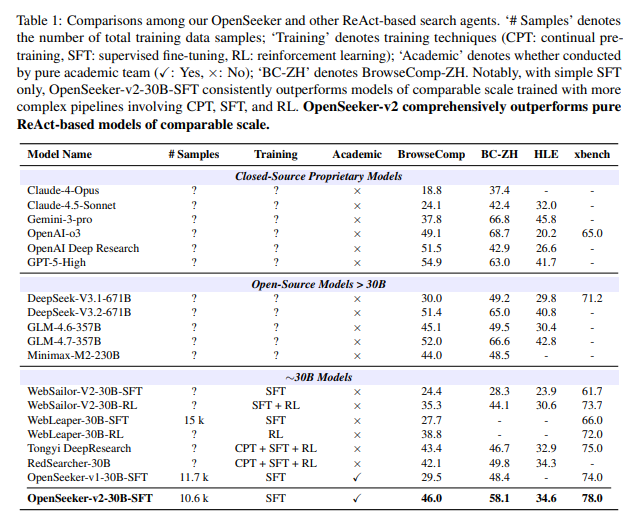

实验数据显示 仅基于1.06万条数据点训练的 OpenSeeker-v2(30B规模 ReAct架构) 在四项核心基准测试中展现了极强的统治力 其在BrowseComp上的准确率达到46.0% 在BrowseComp-ZH上为58.1% 在“人类最后考试”(Humanity’s Last Exam)中表现为34.6% 而在xbench上更是高达78.0% 这一系列成绩不仅刷新了纪录 更全面超越了采用重度CPT+SFT+RL复杂管线训练的工业界模型——通义DeepResearch

值得关注的是 这是首个在同等模型规模与架构下 由纯学术团队仅通过SFT技术实现的 state-of-the-art(SOTA)搜索智能体 目前 该团队已正式开源 OpenSeeker-v2 的模型权重 这一发现极大地降低了前沿搜索智能体的研发门槛 为学术界和开源社区提供了更具参考价值的轻量化开发路径