腾讯正式发布业界领先的混元图像3.0模型,这是全球首个开源的商用级原生多模态图像生成系统。该模型拥有高达80亿参数量,不仅成为目前效果最佳、参数规模最大的开源生图模型,更在性能上与顶尖闭源模型展开激烈竞争。用户现已可通过腾讯混元官网亲身体验这一强大技术,模型的完整权重及加速版本已同步在GitHub和Hugging Face等知名开源社区发布,为全球开发者提供免费下载与使用的宝贵资源。

混元图像3.0的核心突破在于其创新的”原生多模态”技术架构。这一突破性设计彻底改变了传统模型依赖多系统组合的工作方式,让用户能够通过单一平台无缝处理文字、图像、视频及音频等多种数据类型。这种一体化解决方案赋予模型双重能力——既可精准生成视觉内容,又能深度理解语义信息,犹如一位兼具创作思维与艺术感知力的”智能画家”。

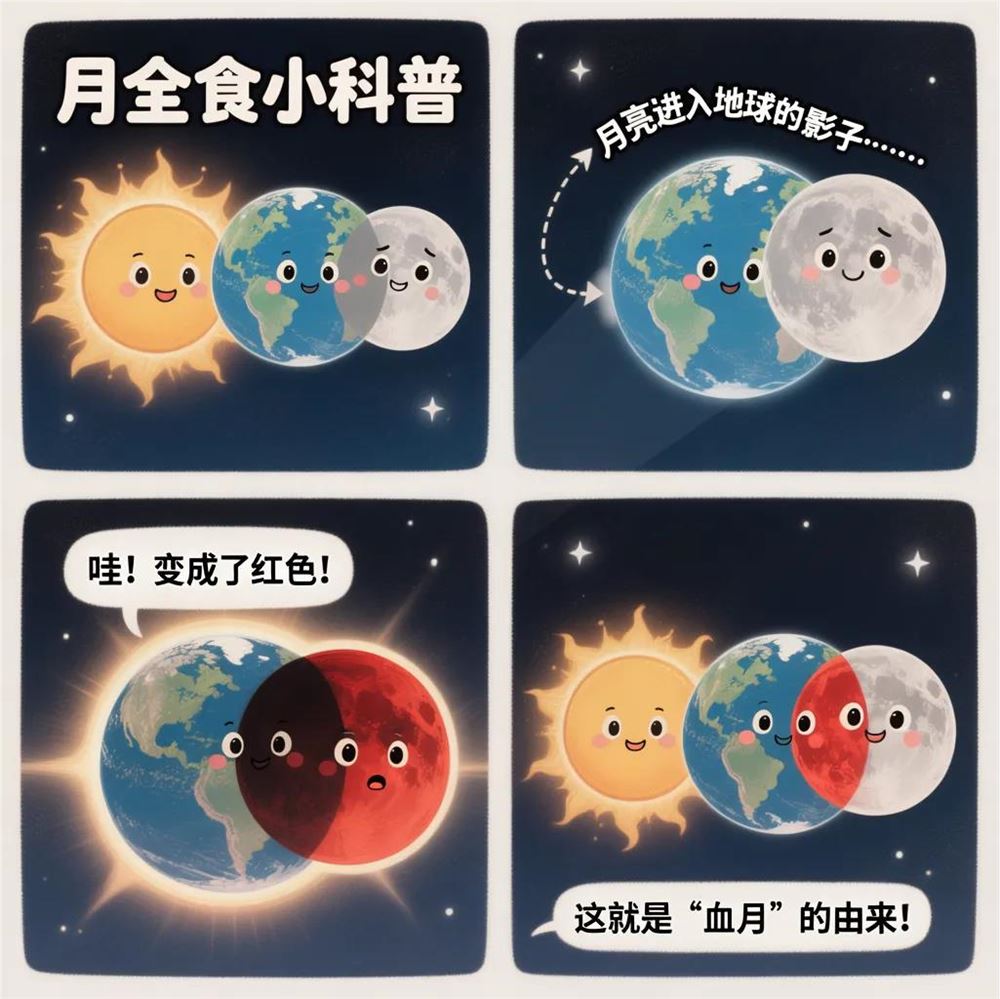

在语义理解与自动生成方面,混元图像3.0实现了革命性跨越。用户只需输入简单提示词,例如”创作一个月全食的四格科普漫画”,模型便能自主完成全部创作流程,无需逐格细化指令。其语义解析能力与美学表现力得到显著提升,不仅可精确实现用户指令,更能胜任图片中的小字标注、长文本生成等高精度要求任务。

官方案例直观展示了模型的应用潜力:当输入”作为小红书穿搭博主,请生成一张封面图片,要求左侧为模特全身OOTD,右侧分解展示深棕色夹克、黑色百褶裙、棕色靴子及黑色包包,风格需为真实感强的实物摄影,呈现秋季美拉德色系穿搭”这一复杂指令时,混元图像3.0能够精准完成衣物分解与风格转换。此外,模型在商品图、海报及插画创作中展现出卓越表现,可满足从电商到内容营销的多样化视觉需求。

混元图像3.0的发布将极大赋能创意产业。无论是专业插画师还是缺乏美术基础的内容创作者,都能通过这一工具在几分钟内完成原本需要数小时的高质量视觉作品,创作效率实现质的飞跃。其技术基础源于腾讯团队基于50亿图文对和6TB海量语料数据的深度多模态混合训练,充分融合了多任务学习效果,构建起强大的语义理解体系。

展望未来,腾讯团队已规划推出图生图、图像编辑、多轮交互等创新功能,持续优化用户体验。目前,用户可通过https://hunyuan.tencent.com/image访问混元官网体验最新技术,所有模型权重及加速版本在GitHub、Hugging Face等平台持续开放免费获取,充分践行开源理念。

划重点:

🌟 混元图像3.0开创性地成为首个开源原生多模态生图模型,参数规模突破80B大关

🖌️ 卓越的语义理解能力让简短提示词即可生成复杂视觉作品

🚀 技术突破将全面提升视觉创作效率,后续将推出更多实用功能