微新创想:随着 AI 模型参数量迈向万亿级别,支撑其训练的 GPU 集群已成为世界上最复杂也最脆弱的机器。为了解决大规模训练中的硬件不稳定性问题,Meta AI 研究团队近日宣布开源 GCM 工具包。这项技术发布不仅标志着 Meta 在高性能计算领域的重要进展,更提供了一套完整的硬件管理蓝图。

在传统的 Web 开发中,服务器延迟可以通过简单的扩容解决,但在 AI 训练中,规则完全不同。一个拥有数千张显卡的集群中,哪怕只有一张 GPU 出现“静默故障”——即表面在线但性能大幅下降——就会像毒药一样污染整个训练任务的梯度,导致数周的算力白白浪费。这种故障往往难以察觉,却对训练效率和结果产生严重影响。

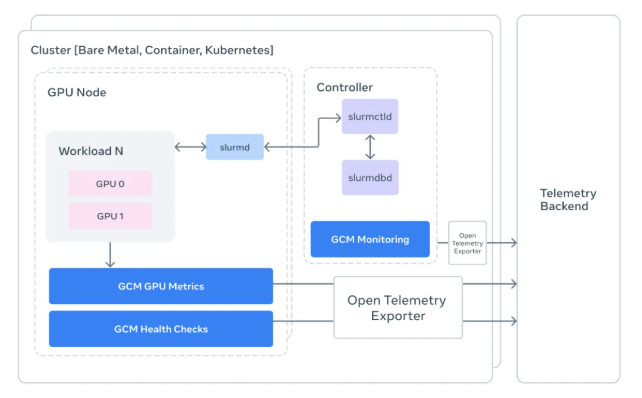

Meta 开发 GCM 的初衷,正是要充当硬件底层遥测数据与上层编排逻辑之间的专业桥梁。通过这一工具,AIbase 发现 GCM 深度集成了业界通用的任务调度器 Slurm。它能够实现“任务级”的监控:工程师不再只能看到模糊的功耗波动,而是能精准定位到是哪个任务 ID 导致了性能下滑。这种精准的监控能力,为故障排查提供了前所未有的清晰视角。

此外,GCM 引入了严苛的“前后置检查”机制。在任务开始前,它会确认网络与 GPU 是否可达;在任务结束后,则调用 NVIDIA DCGM 进行深度诊断。通过将复杂的底层硬件数据转化为标准化的 OpenTelemetry 格式,GCM 让运维团队能够像监控网页流量一样,直观地在 Grafana 等面板上看到 GPU 的“健康体检报告”。

GCM 的推出,不仅提升了 AI 训练环境的稳定性,也为大规模计算资源的管理提供了新的思路。它通过智能化的监控与诊断手段,帮助用户在问题发生前就识别并处理潜在风险,从而确保昂贵的算力资源不被浪费,提高整体训练效率和可靠性。