微新创想:通义实验室今日正式发布两款支持“FreeStyle”指令生成的语音大模型:Fun-CosyVoice3.5与Fun-AudioGen-VD。此次发布标志着语音生成技术从依赖预设标签的传统模式,向基于自然语言指令自由控制的新范式转变,实现了“一句话自由生成语音”的深度交互体验。这一突破为语音技术的应用场景打开了全新的大门,使得语音生成更加灵活、高效和富有创造力。

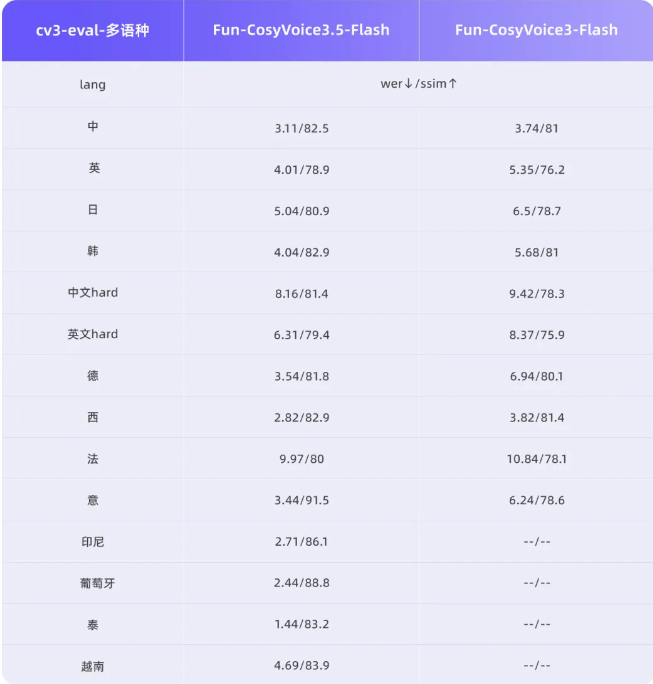

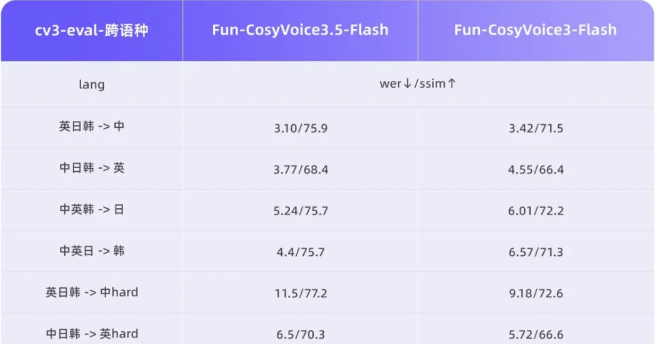

Fun-CosyVoice3.5在技术架构与功能升级方面表现出色。该模型特别注重多语种复刻与精细化表达,新增了泰语、印尼语等四个语种的支持。通过引入DiffRO与GRPO强化学习技术,Fun-CosyVoice3.5在语音的韵律表现和音质相似度方面有了显著提升。其生僻字读错率从15.2%大幅下降至5.3%,首包延迟也降低了35%,在语音生成的准确性和效率上实现了双重突破。

Fun-AudioGen-VD则专注于声音设计与场景化建模。该模型能够通过指令精确控制语音的性别、情绪以及空间声学效果,从而模拟出从“疯狂反派”到“热闹咖啡馆”等复杂且富有沉浸感的角色与背景音一体化场景。这种高度定制化的语音生成能力,使得Fun-AudioGen-VD在影视、游戏及虚拟角色创作等领域展现出巨大的应用潜力。

从行业趋势来看,通义实验室的这一发布不仅将语音生成从单纯的转换工具升级为创作工具,还为内容生产提供了更丰富的可能性。这种可描述、可编排的数字表达能力,有助于降低内容创作成本,同时极大拓展了人机交互的语义丰富度。无论是语音合成还是声音设计,用户都可以通过自然语言指令实现更精准、更个性化的语音生成需求。

未来,随着语音大模型技术的不断成熟,其在多个行业的应用将进一步深化。无论是娱乐产业还是人工智能领域,语音生成技术都将成为推动创新的重要力量。通义实验室的这一系列成果,无疑为行业带来了新的发展机遇,也为用户提供了更便捷、高效的语音创作体验。