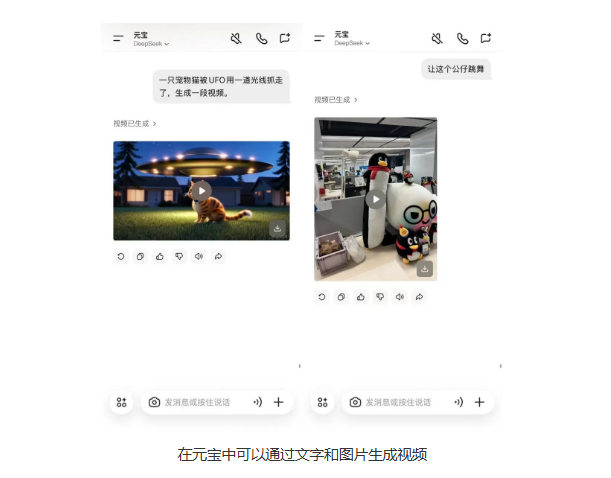

腾讯混元大模型团队今日正式推出其最新力作——HunyuanVideo1.5视频生成模型,这一突破性进展为视频生成技术领域注入了新的活力。这款基于Diffusion Transformer(DiT)架构的轻量级模型,参数量仅为8.3B,却能够生成5至10秒的高清晰度视频片段,展现了卓越的性能表现。目前,该模型已在腾讯的「元宝」平台上线,为广大用户提供免费体验的机会。

HunyuanVideo1.5支持多样化的生成方式,用户既可以输入文字描述(Prompt)实现“文生视频”,也可以上传图片结合文字,将静态图像转化为生动动态的视频。这一创新技术不仅完美支持中英文输入,更在图像与视频的一致性上表现出色,确保生成视频在色调、光影、场景、主体及细节等方面与原图高度契合。例如,当用户输入提示词描述一只手提箱里如何生长出迷你英式花园时,模型能够精准呈现这一过程,展现出高水平的指令理解与遵循能力。

在风格多样性方面,HunyuanVideo1.5同样表现出色,支持写实、动画等多种风格,并能够在视频中生成中英文文字,极大地拓宽了内容创作的可能性。技术上,该模型采用了创新的SSTA稀疏注意力机制,显著提升了推理效率,同时结合多阶段渐进式训练策略,在运动连贯性和语义遵循等关键维度达到了商用水平。

更令人惊喜的是,HunyuanVideo1.5的部署门槛极低,只需14G显存的消费级显卡即可流畅运行,让每一位开发者和创作者都能轻松参与到视频生成的创新浪潮中。相比之下,此前视频生成领域的开源SOTA旗舰模型通常需要超过20B的参数和50GB显存的支持,HunyuanVideo1.5的发布不仅在生成效果上实现了质的飞跃,更在性能与尺寸之间找到了完美平衡。

目前,HunyuanVideo1.5已上传至Hugging Face和GitHub,广大开发者可随时下载体验。随着HunyuanVideo1.5的问世,腾讯进一步巩固了其在人工智能和视频生成领域的领导地位,为内容创作者提供了更强大的工具和无限的创作可能。未来,随着技术的不断发展,视频生成的应用场景将更加广泛,我们有理由期待HunyuanVideo1.5能为行业带来更多变革与创新。