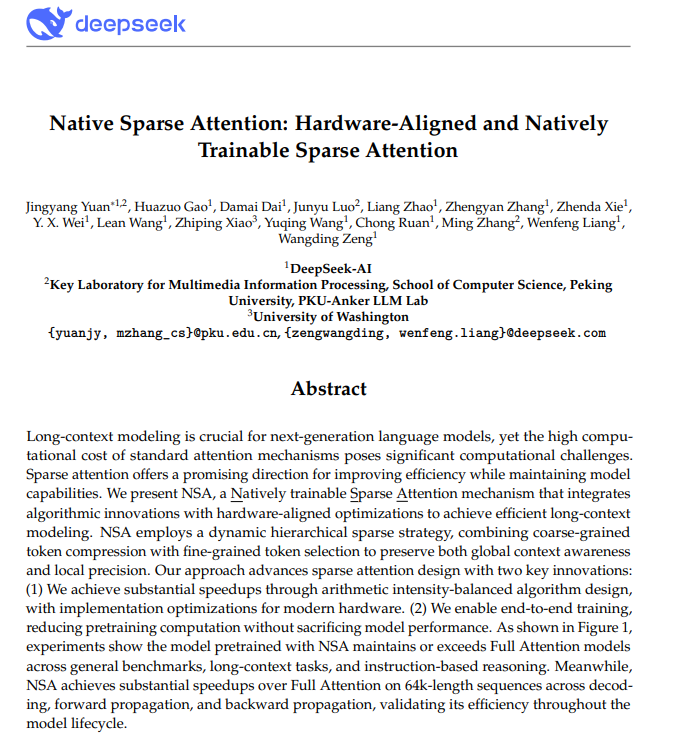

ACL2025颁奖典礼上,DeepSeek的梁文锋博士领衔的研究团队再创佳绩,其作为通讯作者联合北京大学等机构发表的研究论文一举斩获最佳论文奖。此次会议规模空前,共有8360篇投稿,竞争之激烈可见一斑,该论文的获奖实至名归。

该论文提出了一种创新的原生稀疏注意力(NSA)机制,通过算法与硬件的协同优化,将长文本处理速度提升至惊人的11倍。更令人振奋的是,NSA不仅实现了性能飞跃,还超越了传统的全注意力模型。借助这项技术,研究团队成功将上下文长度扩展至100万tokens,为未来前沿模型的发展奠定了坚实基础。

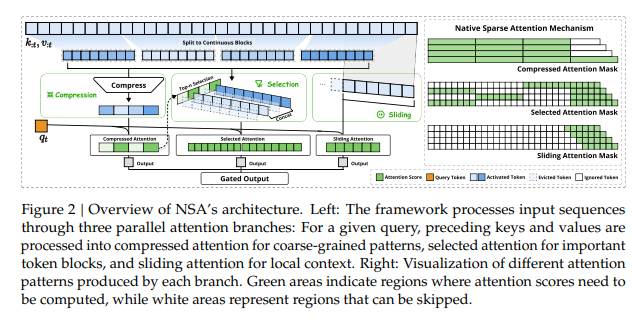

NSA机制的核心在于动态分层的稀疏策略,结合三条并行的注意力分支,高效捕捉文本中的关键信息。首先是”压缩注意力”分支,负责提炼全局信息;其次是”选择性注意力”分支,精准聚焦重要词块;最后是”滑动注意力”分支,确保局部上下文的完整性。这种创新设计不仅提升了模型的灵活性,更在现代GPU硬件上实现了深度优化,支持原生可训练模式。

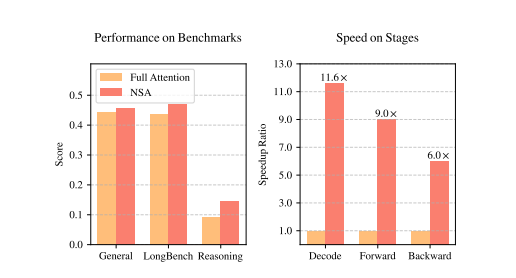

测试结果表明,NSA在处理64k长度文本时,解码阶段速度提升了11.6倍,前向传播和反向传播速度分别提高了9倍和6倍。更值得关注的是,NSA在各种基准测试中表现卓越,27B参数模型在9个评测指标中创造了7项最佳成绩,特别是在多跳问答和代码理解等复杂任务中展现出明显优势。

这项研究为长文本处理领域开辟了全新路径,真正实现了速度与精度的双赢,充分证明了NSA机制在人工智能领域的广泛应用前景。论文详情请参阅:https://arxiv.org/pdf/2502.11089