360智脑团队正式发布革命性Light-IF系列模型,这一创新框架致力于突破大型语言模型(LLM)在复杂指令遵循方面的瓶颈。尽管当前AI技术在数学、编程等领域已展现出惊人的推理能力,但在处理复杂指令时仍存在明显短板。为攻克这一难题,360智脑团队研发出以预览-自检式推理与信息熵控制为核心技术的Light-IF框架。该框架通过五大关键技术环节协同作用,全面提升模型性能:难度感知指令生成、Zero-RL强化学习、推理模式提取与过滤、熵保持监督冷启动、熵自适应正则强化学习。这一突破性设计旨在彻底解决当前推理模型普遍存在的”懒惰推理”问题——即模型在思考阶段机械复述指令却缺乏主动验证约束条件的意识,最终导致指令执行偏差。

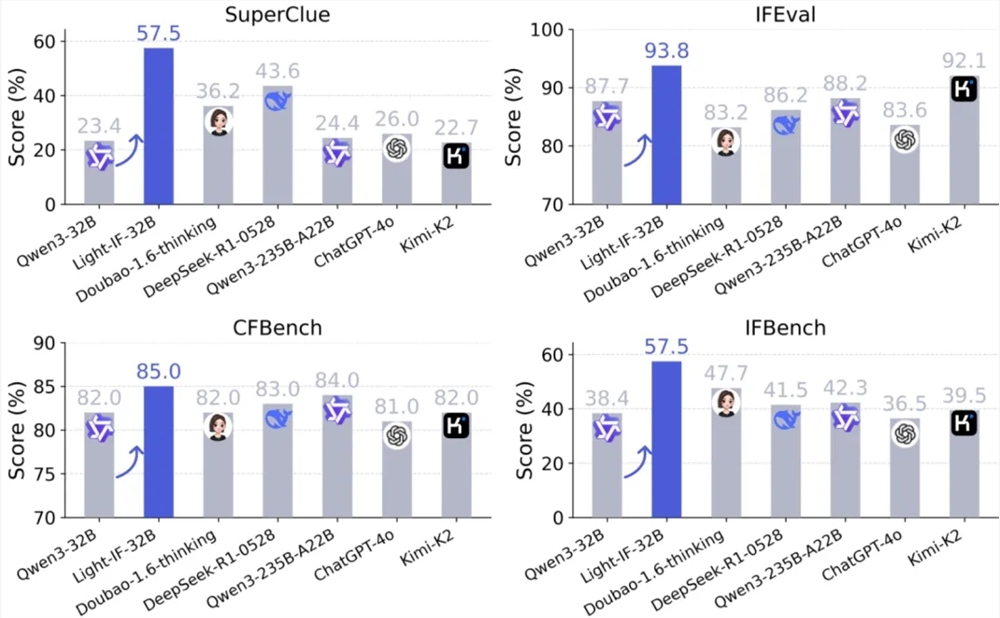

在权威评测中,Light-IF系列模型在SuperCLUE、IFEval、CFBench及IFBench四大中文与跨语言指令遵循基准上均实现跨越式提升。其中32B版本Light-IF-32B表现尤为亮眼,SuperClue得分高达0.575,较次优模型领先13.9个百分点。更令人瞩目的是参数量仅为1.7B的Light-IF-1.7B,其SuperClue和IFEval表现竟超越Qwen3-235B-A22B等超大规模模型。这些实验结果充分证明,Light-IF框架在保持高效性的同时实现了卓越的推理能力。

360智脑团队强调,此次发布的Light-IF系列不仅为开源社区提供了一套完整可复现的技术路线,更配套开放了全部开源代码。所有模型将陆续登陆Hugging Face平台,供全球开发者使用、对比与验证。同时,训练过程中使用的冷启动数据集也将同步在GitHub上开放。值得一提的是,360与SuperCLUE联合研发的中文精确指令遵循测评基准SuperCLUE-CPIFOpen同样开源,为研究者提供专业评测工具。这一系列举措标志着360智脑在复杂指令遵循领域取得重大突破,为人工智能技术从理论走向更广泛应用开辟了全新路径。