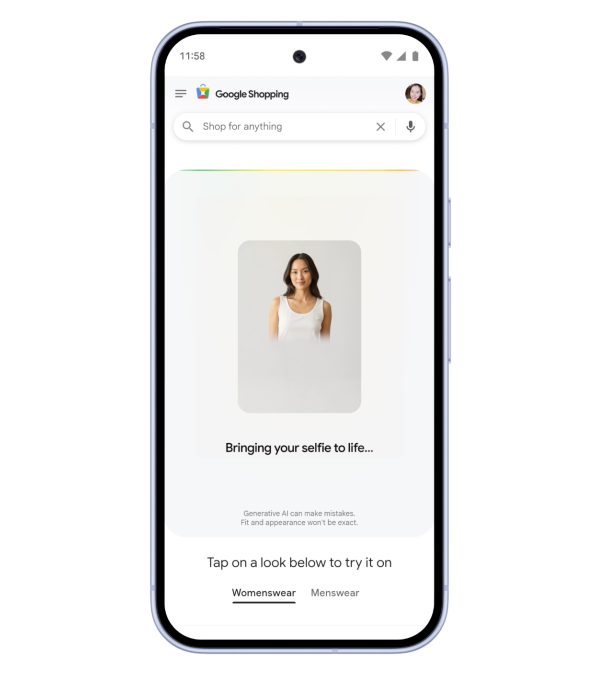

只需一张自拍,即可在数秒内生成专属的全身数字形象,并试穿心仪的服装——谷歌于周四正式宣布,其AI虚拟试穿功能迎来重大突破性升级。过去,用户需要提供完整的全身照片才能使用该功能;如今,借助名为Nano Banana的Gemini2.5Flash图像模型,系统能够从普通自拍照中智能“脑补”出用户的全身轮廓,并呈现逼真的虚拟试穿效果。新功能允许用户输入常穿尺码,AI将据此生成多张不同姿态的试穿图像供选择,用户可挑选最满意的一张设为默认试穿形象。此外,用户仍可选择上传全身照,或直接使用平台提供的丰富虚拟模特形象——涵盖各种体型、肤色与身形,全面满足多样化的试穿需求。这项升级已于即日起在美国正式上线。自去年7月首次推出以来,谷歌的虚拟试穿功能已整合进Google Search、Google Shopping和Google Images,用户只需点击商品列表中的“试穿”按钮,即可直观预览上身效果。此次自拍生成全身像的能力,大幅降低了使用门槛,让虚拟试衣从“需要准备”变为“随手可做”。这并非谷歌在AI试衣领域的唯一尝试。公司还运营着一款名为Doppl的独立应用,专注于AI驱动的穿搭可视化。本周,Doppl刚刚更新了“可购物发现流”——一个由AI生成的短视频推荐页,根据用户的风格偏好推送搭配建议。视频中展示的每一件商品均可直接跳转购买,背后连接着真实商家。尽管AI生成内容仍面临审美与真实性的争议,但谷歌显然押注于这种形式的传播效率:短视频、个性化推荐、即时试穿——这套组合拳精准复刻了TikTok和Instagram等平台用户早已习惯的互动逻辑。在电商与生成式AI深度融合的赛道上,谷歌正用一张自拍,悄然重塑我们“看图购物”的未来。