微新创想:DeepSeek在2月11日发布了一个名为DeepSeek V4 Lite的新模型,尽管它没有达到春节档发布的DeepSeek V4的规模,但参数量仅有2000亿,相对较小。这个模型的主要亮点在于支持1M的上下文长度,这在处理长文本任务时具有一定的优势。然而,此前网友的测试反馈显示,除了超长上下文之外,其整体表现并没有特别惊艳,因为参数规模与主流大模型相比仍有差距。

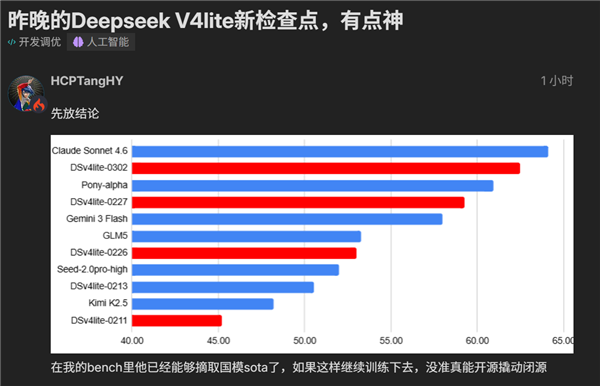

然而,自DeepSeek V4 Lite发布以来,其性能一直在持续提升。2月27日,已经有网友测试发现,该模型的表现逐渐增强。昨日再次升级后,Linux Do社区的大佬HCPTangHY进行了测试,并表示非常震惊,认为DeepSeek V4 Lite在此次升级后已经达到了国产模型的最先进水平,甚至在某些方面超越了当前主流的闭源模型。

不仅如此,HCPTangHY还指出,如果DeepSeek V4 Lite能够继续训练下去,未来有可能通过开源的方式对闭源模型形成有力挑战。从他的测试结果来看,0302版本的DeepSeek V4 Lite在各项指标上的得分比0227版本有了明显提升,已经非常接近目前最顶尖的闭源模型Sonnet 4.6。

在测试中,除了常规的文本生成任务外,DeepSeek V4 Lite还通过了多个行业知名的测试项目,包括游戏和前端开发相关的测试。其中,备受关注的天气卡测试表现尤为突出,无论是从视觉设计还是功能实现上,都展现出了在线级的优秀表现。

回顾过去一年的AI大模型发展,国产大模型在对话聊天方面已经与闭源模型差距不大。但在多模态、编程、数学以及智能体等更复杂的领域,仍然存在一定的不足。最近发布的GLM5、MiniMax 2.5和Qwen 3.5系列在这些方面有所进步,但面对Anthropic、OpenAI和谷歌等国际巨头推出的新模型,差距又有所扩大。

国内公司在追赶顶流闭源模型的过程中,面临诸多挑战。首先是投入资源相对有限,相较于美国的科技巨头,国内企业在研发资金上的支持仍然不足。其次是算力方面的差距,大模型的训练和优化需要强大的计算能力,而国内在这一方面仍处于追赶阶段。此外,数据资料的积累也是一大难题,谷歌和OpenAI凭借多年的技术积累和庞大的用户基数,拥有更丰富的训练数据。

值得一提的是,Anthropic为了获取训练数据,曾从盗版网站下载大量书籍,这一行为引发了广泛争议,并最终导致其被法院判决赔偿15亿美元。这反映出国际大模型公司对数据获取的极端重视,以及在这一过程中可能采取的激进手段。

作为国产大模型的代表之一,DeepSeek在技术探索方面已经树立了良好的标杆。即便是在参数规模较小的情况下,DeepSeek V4 Lite依然展现出强大的潜力,这让人对完整版的DeepSeek V4充满期待。一旦正式发布,它很可能会在国际市场上引发新的竞争格局,对美国AI企业形成有力冲击。