腾讯近日正式宣布开源其创新性文档理解与语义检索框架——WeKnora(维娜拉),为复杂异构文档场景提供企业级智能问答解决方案。这一开源项目致力于构建高效可控的端到端文档问答流程,通过现代化模块化设计打造完整的文档理解与检索流水线。

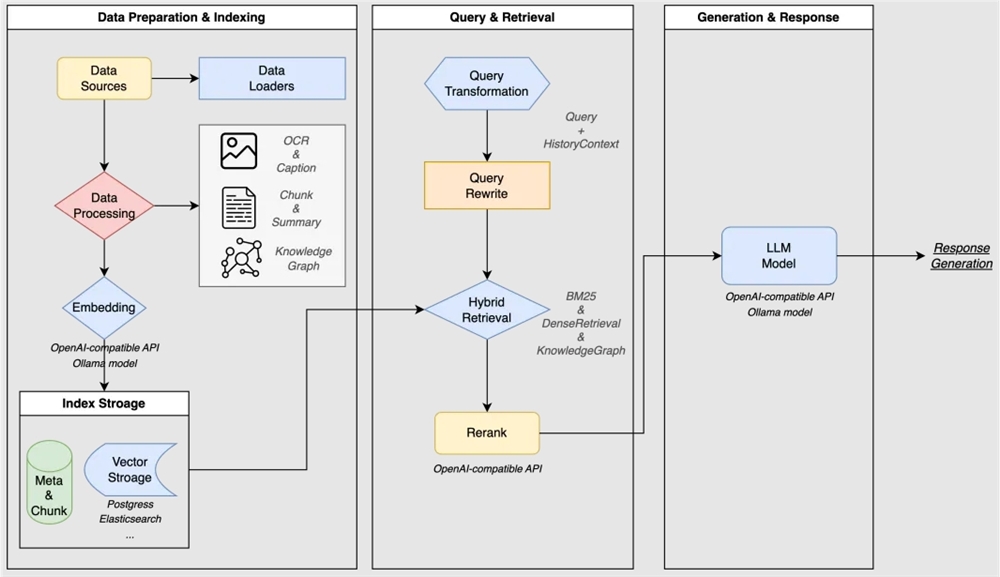

WeKnora整体架构包含五大核心模块:文档处理层能够解析多种格式文档,将非结构化内容转化为结构化数据;知识建模层运用向量化、分块、知识图谱和索引技术构建知识表示;检索引擎层集成多元检索策略实现高效内容召回;推理生成层借助大语言模型深度理解检索结果;交互展示层提供直观用户界面和标准API接口。该框架基于大语言模型技术,深度融合多模态预处理、语义向量索引、智能召回与大模型生成推理等前沿技术。

WeKnora技术亮点突出,其多模态认知引擎可精准解析PDF、Word文档及图片中的图文混排内容,通过OCR与跨模态建模技术构建统一结构化知识中枢。模块化RAG流水线设计支持自由组合检索策略、大语言模型与向量数据库,可无缝集成Ollama等平台,灵活切换Qwen、DeepSeek等主流模型,满足企业知识库定制化需求。通过私有化部署、多轮上下文深度理解与全链路可视化评估,为高敏感场景提供可靠知识支撑。

在部署方面,WeKnora支持本地化部署和Docker镜像,兼容私有云及离线环境,内置完善监控日志体系,提供全链路可观测性。开箱即用的交互体验包括一键启动脚本和直观Web UI界面,非技术用户也能轻松完成文档索引、智能问答等服务的部署与应用。

WeKnora适用于企业知识管理、科研文献分析、产品技术支持、法律合规审查、医疗知识辅助等多种场景。其Web界面支持拖拽上传各类文档,自动识别文档结构并提取核心知识建立索引。知识图谱可视化功能可将文档转化为可视化图谱,展示段落间关联关系,显著提升检索结果的相关性和广度。

部署方式灵活多样:本地部署提供完整Docker化方案,用户通过简单命令即可快速启动服务。作为微信对话开放平台核心技术框架,WeKnora还支持零代码部署,用户只需上传知识即可在微信生态快速部署智能问答服务,实现”即问即答”体验。通过微信对话开放平台,其智能问答能力可无缝集成到公众号、小程序等场景,大幅提升用户交互体验。

WeKnora采用MIT协议开源,欢迎社区用户参与贡献,包括Bug修复、功能开发、文档改进和用户体验优化等。腾讯期待与开发者共同构建更智能、更高效的文档理解与检索新范式。项目地址为https://github.com/Tencent/WeKnora,开发者可访问GitHub仓库获取更多详情。