微新创想:中国大模型正在全模态交互领域实现从“追随”到“领跑”的华丽转身。3月30日,阿里正式发布千问新一代全模态大模型Qwen3.5-Omni。该模型凭借混合注意力MoE架构,实现了图片、视频、语音及文字的无缝全模态输入与输出,标志着国产大模型在视听交互领域达到了全球顶尖水平。

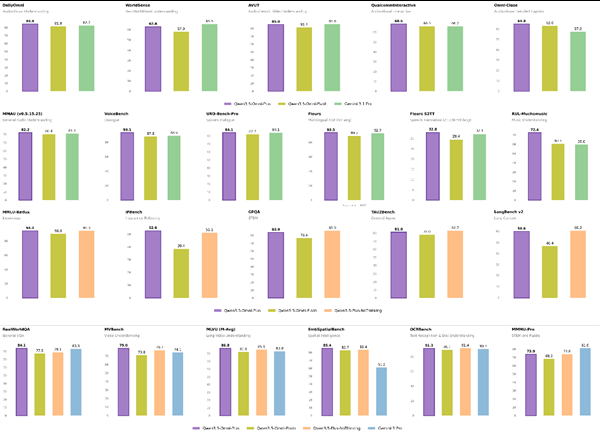

全能战力:215项任务夺冠,硬核超越Gemini在衡量大模型综合实力的硬指标上,Qwen3.5-Omni展现出了统治级的表现。SOTA霸榜:在音视频理解、识别与交互等共计215项测试任务中,该模型均取得SOTA(性能最佳)表现。对标优胜:在DailyOmni、QualcommInteractive等聚焦视听交互的测试中,其得分大幅领先Google的Gemini-3.1Pro。抗干扰神技:在嘈杂环境下的WenetSpeech测试中,其识别准确率极高,错误率远低于对手。

交互革命:113种语言识别与“动动嘴”编程Qwen3.5-Omni不仅更聪明,而且更懂“方言”和“代码”。语言专家:支持113种语言及方言的识别,甚至是毛利语、海南方言等小众语言也能精准捕捉。Vibe Coding进化:开启了音视频编程新时代。用户只需打开摄像头,对着草图口述需求,模型即可直接生成带有复杂UI的产品原型界面,真正实现“所说即所得”。

生产力爆发:10小时音频长程理解针对专业领域,新模型提供了极强的结构化处理能力。视频深度拆解:能对画面主体、人物关系及情绪起伏进行极细颗粒度的拆解。自动切片:支持超过10小时的音频输入,并能自动完成视频章节切片与时间戳标注,极大提升了内容创作效率。

普惠生态:价格仅为Gemini的十分之一阿里云百炼平台已同步上线Plus、Flash、Light三种API,旨在为企业提供最具性价比的选择。成本极低:每百万Tokens输入成本低于0.8元,价格不到Gemini-3.1Pro的十分之一。市场领先:目前千问已服务超100万家客户,稳居中国企业级大模型调用市场第一。

结语:从“理解文字”到“感知世界”Qwen3.5-Omni的发布,不仅是阿里技术实力的展现,更是国产大模型迈向“全能交互”的重要里程碑。当模型能够像人类一样听懂方言、看懂草图、理解情绪,AI将真正从屏幕里的对话框走出来,成为各行各业触手可及的超级生产力工具。