微新创想11月21日重磅报道,腾讯混元大模型团队今日正式宣布开源其最新研发的视频生成模型——HunyuanVideo 1.5。这款基于Diffusion Transformer(DiT)架构的轻量级模型,拥有8.3B的精妙参数量,能够高效生成5至10秒的高清视频片段。令人惊喜的是,该模型已率先在腾讯元宝平台上线,为普通用户提供了零门槛的体验机会。

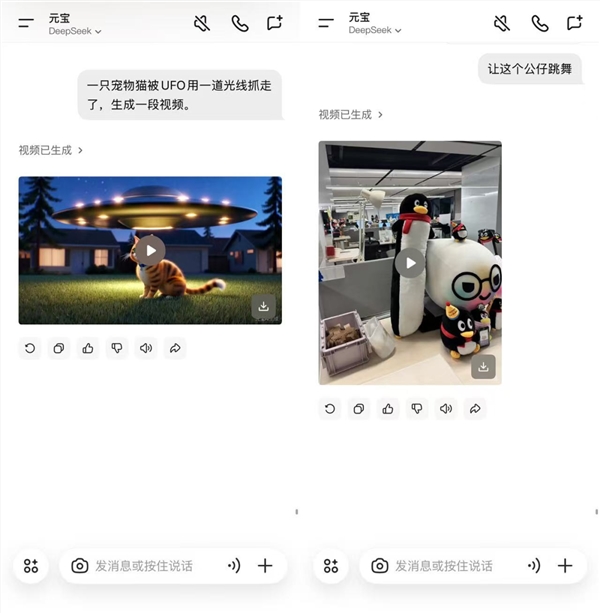

用户可以通过两种直观的方式与HunyuanVideo 1.5互动:一是输入富有创意的文字描述(Prompt),即可实现从文字到视频的神奇转化;二是上传静态图片并配合Prompt,轻松将静态画面赋予动态生命力。据团队介绍,HunyuanVideo 1.5展现出卓越的全能表现,完美支持中英文输入的文生视频与图生视频功能。尤其在图生视频方面,模型能够实现图像与视频的高度一致性,无论是色调、光影、场景布局,还是主体特征和细节纹理,都能与原图实现精准匹配。

模型还具备强大的指令理解与遵循能力,能够精准执行多样化场景创作指令,包括运镜技巧、流畅运动轨迹、真实的物理规律模拟、写实人物塑造以及细腻的人物情绪表情表达等。在元宝平台中,用户可以自由切换文字或图片生成视频的模式,同时HunyuanVideo 1.5支持写实、动画、积木等多种艺术风格,并可在视频中无缝嵌入中英文文字,全面满足不同场景下的内容创作需求。

在画质表现方面,HunyuanVideo 1.5能够原生生成480p和720p的高清视频,并通过先进的超分模型技术,将画质进一步提升至1080p的电影级水准。值得注意的是,此前视频生成领域的开源SOTA旗舰模型往往参数量超过20B,且需要配备超过50GB显存的顶级显卡才能部署。而HunyuanVideo 1.5以其创新的”开源小钢炮”定位,显著降低了使用门槛,仅需14G显存的消费级显卡即可流畅运行,真正让每一位开发者和创作者都能轻松上手。

HunyuanVideo 1.5通过多层次的技术创新,在生成效果、性能与模型尺寸之间实现了完美平衡。其创新的SSTA稀疏注意力机制(Selective and Sliding Tile Attention,选择性滑动分块注意力),在确保高质量生成效果的同时,大幅提升了推理效率。配合多阶段渐进式训练策略,模型在运动连贯性、语义遵循等关键维度均达到了商用级水平,为视频生成领域树立了新的标杆。